Ollama를 사용하여 모든 웹 페이지와 채팅하는 방법

당신도 아마 변화가 일어나고 있다는 것을 느꼈을 것입니다. ChatGPT가 어디에나 있지만, 동시에 그에 대한 불안감도 커지고 있습니다. 붙여넣은 문서는 어떻게 되는 걸까요? 누가 당신의 프롬프트를 읽고 있을까요? 당신의 고용주나 클라이언트가 당신이 AI를 사용했다는 사실을 알 수 있을까요?

이런 질문들은 당연한 것입니다. 그리고 조용히 이런 질문 자체를 멈춘 사람들이 늘고 있는데, 그 이유는 AI 환경을 로컬에서 실행하도록 옮겼기 때문입니다.

이 글이 바로 그 이야기를 다룹니다. Ollama가 무엇인지, 어떻게 설정하는지, 어떤 모델을 사용하는 것이 좋은지 설명한 다음, 진짜 흥미로운 부분인 브라우저 내에서 AI를 직접 사용해 보고 있는 웹 페이지와 상호작용하는 방법까지 살펴보겠습니다. 구독료도 없고, 원하지 않는 한 데이터가 머신을 떠나지도 않습니다.

당신이 개발자이든 연구원이든 기자이든, 아니면 AI에 호기심이 많고 모든 쿼리가 어디에선가 기록된다는 생각을 좋아하지 않는 일반 사용자이든 모두에게 이 글이 도움이 될 것입니다.

우선, Ollama란 무엇인가?

Ollama는 무료 오픈소스 도구로, 대형 언어 모델을 직접 자신의 컴퓨터에서 다운로드하여 실행할 수 있게 해줍니다. Mac, Windows, Linux 모두 지원합니다.

모델 관리자로 생각하세요. 모델을 선택하고 한 번 다운로드하면, 이후부터는 전적으로 자신의 하드웨어에서 실행됩니다. 인터넷 연결 불필요. 사용 비용 없음. 제3자 서버가 쿼리를 처리하지 않습니다.

ChatGPT가 처음 출시될 때는 강력한 AI 모델이 클라우드 서비스를 통해서만 접근 가능했습니다. 이제는 동등한 모델을 완전히 로컬에서, 그리고 프라이빗하게 구동할 수 있으며, 더 높은 성능이 필요할 때는 Ollama의 클라우드를 활용할 수도 있습니다. 도구를 바꾸거나 워크플로우를 변경할 필요 없이 말이죠. 이 부분은 뒤에서 더 자세히 다루겠습니다.

실제로 이것이 주는 이점은 생각보다 큽니다. Ollama에 민감한 문서, 개인 노트, 기밀 웹 페이지를 넣어도, 사용하는 모드에 따라 그 내용이 어디로도 전송되지 않을 수 있습니다. 그리고 조용히 쌓여 매달 비용이 되는 토큰별 사용료를 걱정할 필요도 없습니다.

사람들은 Ollama를 어떻게 사용할까?

설정 방법 전에, 실제 사용 사례를 짚어보는 것이 좋습니다. "로컬에서 AI 실행"이라는 말은 다소 추상적으로 들릴 수 있거든요.

사람들은 예상 외로 다양한 작업에 로컬 모델을 사용합니다: 긴 보고서 요약, 이메일 초안 작성, 코드 디버깅, 쿼리를 저장하지 않고 연구 수행, 계약서 분석, 회의록 처리 등. 개발자는 통제된 환경에서 모델 동작을 테스트하고, 작가는 자신의 초안에 대한 피드백을 받으면서 작품이 학습 데이터로 활용되는 것을 걱정하지 않습니다. 학생들은 구독료를 소모하지 않고 복잡한 주제를 공부하는 데 사용합니다.

공통된 핵심은 ‘통제’입니다. Ollama 사용자들은 구독 포털을 통해 가격이 바뀌거나 속도 제한을 당하거나 세션이 기록되는 것을 원하지 않고, 자신이 원하는 방식으로 AI와 함께 작업하기를 원합니다.

Ollama 설치하기

필요한 것

최신 기계가 꼭 필요한 건 아니지만, RAM이 중요합니다. 대부분 모델을 편안하게 사용하려면 최소 16GB를 권장합니다. 8GB도 가능하지만 가장 작은 모델만 쓸 수 있고 반응 속도가 느릴 수 있습니다. Apple Silicon을 사용하는 Mac이라면 특히 좋은 환경입니다. 통합 메모리 구조가 로컬 AI를 효율적으로 처리해주기 때문입니다. Windows와 Linux도 잘 작동합니다.

설치하기

Ollama는 주요 플랫폼(macOS, Linux, Windows)을 지원합니다. 가장 쉬운 설치 방법은 다음과 같습니다:

# On macOS or Linux

curl -fsSL https://ollama.com/install.sh | sh

# Or use Homebrew on macOS

brew install ollama

# On Windows, download the installer from Ollama’s website https://ollama.com/download/windows설치되면 Ollama는 백그라운드에서 포트 11434로 로컬 서버를 실행합니다. 브라우저에서 http://localhost:11434에 접속해 확인할 수 있습니다. 확인 메시지가 보이면 정상 작동 중입니다.

첫 모델 다운로드

터미널을 열고 다음을 실행하세요:

ollama pull llama3.2Meta의 Llama 3.2 모델(~2GB)을 컴퓨터에 다운로드합니다. run 명령어를 사용하면 다운로드를 자동으로 처리하며, 아래 명령을 바로 실행해도 됩니다:

ollama run llama3.2질문을 입력하고 답변을 받아보세요. 이제 강력한 언어 모델이 완전히 당신 하드웨어에서 실행되고 있는 상태입니다.

어떤 모델을 써야 할까?

Ollama 라이브러리에는 100개가 넘는 모델이 있어 처음엔 부담스러울 수 있습니다. 실용적인 출발점은 다음과 같습니다:

| 모델 | 용도 | 필요한 RAM |

|---|---|---|

gemma3:2b |

자체 사양이 낮거나 오래된 기기용 | 약 4GB |

llama3.2 |

일반적인 일상 사용 | 약 8GB |

mistral |

속도와 코딩 작업 | 약 8GB |

deepseek-r1 |

분석, 추론, 연구 | 약 8GB |

llama3.3:70b |

로컬 최대 성능 | 약 32GB 이상 |

처음 시작한다면 llama3.2가 가장 적합합니다. 빠르고 균형 잡혔으며 대부분 최신 노트북에서 무리 없이 실행됩니다.

설치한 모델 목록을 확인하고 싶다면 다음 명령을 사용하세요:

ollama list알아둘 점: 이 모델들은 지식 컷오프 날짜가 있으며 실시간 정보에는 접근하지 못합니다. 현재 보고 있는 웹 페이지 같은 실시간 콘텐츠는 직접 컨텍스트를 제공해야 합니다. 바로 이 부분을 다음에 다룰 예정입니다.

더 크고 강력한 모델이 필요하면?

로컬 모델은 하드웨어 한계가 있습니다. 70B 매개변수 모델은 상당한 RAM을 필요로 하고, 671B 모델은 개인용 컴퓨터에서 실행할 수 없습니다.

이때 Ollama의 클라우드 모델을 이용할 수 있습니다. 2025년 말에 출시되어, 이미 익숙한 Ollama 인터페이스로 대형 모델을 데이터센터급 하드웨어에서 실행할 수 있습니다. 명령어, API, 도구가 동일합니다.

ollama run deepseek-v3.1:671b-cloud사용 가능한 클라우드 모델 예시:

deepseek-v3.1:671b-cloud: 가장 강력한 공개 가중치 모델 중 하나qwen3-coder:480b-cloud: 코딩 작업용으로 특별 설계됨gpt-oss:120b-cloud및gpt-oss:20b-cloud: OpenAI의 공개 가중치 모델

클라우드 모델은 로컬 모델과 행동이 동일합니다. 차이점은 ollama.com에 로그인해야 한다는 점:

ollama signin중요: Ollama 클라우드는 데이터를 보유하지 않습니다. 따라서 대형 클라우드 모델의 힘을 프라이버시 손해 없이 얻을 수 있습니다.

실용적인 결론: 민감한 작업에는 로컬 모델을 사용해 아무 데이터도 외부로 나가지 않게 하고, 최대 성능이 필요할 때는 클라우드 모델을 사용하세요. Ollama가 두 환경을 매끄럽게 관리하며, -cloud로 끝나는 태그를 선택하면 됩니다.

실제 업무를 바꾸는 부분: 웹 페이지와 대화하기

이제 진짜 흥미로운 부분입니다.

Ollama 자체로도 유용하지만, 이를 브라우저에 연결해 어떤 웹 페이지든 그 화면에 있는 내용에 대해 질문할 수 있게 하는 순간, "멋진 실험"에서 "매일 사용하는 도구"로 변합니다.

열어두고 생각해보세요:

- 복잡한 연구 논문을 읽고 있나요? 방법론 요약, 결과를 쉬운 말로 설명, 의심스러운 부분을 지적하도록 요청할 수 있습니다.

- 경쟁사 가격 페이지를 검토 중인가요? 차별점이 무엇인지, 눈에 띄게 빠진 점이 무엇인지 물어보세요.

- 긴 뉴스 기사를 보고 있나요? 핵심 주장, 제목과 내용 일치 여부 확인, 반대 의견 듣기 가능합니다.

- 구인 공고를 보고 있나요? 자신의 경험이 실제 요구사항과 맞는지 물어볼 수 있습니다.

- 법률 문서나 서비스 약관을 검토 중인가요? 민감한 내용을 클라우드에 붙여넣지 않고 쉬운 언어로 설명받을 수 있습니다.

모든 것이 당신 뜻대로 이루어집니다. 페이지 내용은 당신이 선택한 모델에만 전달됩니다.

SurfMind으로 하는 방법

**SurfMind**는 바로 이 목적을 위해 만든 브라우저 확장입니다. 현재 보고 있는 페이지 내용을 읽고, 복사·붙여넣기 없이 브라우저에서 직접 대화를 나눌 수 있습니다.

로컬 Ollama 모델은 물론 Ollama 클라우드 모델도 바로 지원하여, 당신만의 조건으로 웹 전체를 아우르는 강력한 AI 조수를 제공합니다.

연결 방법은 다음과 같습니다:

1단계. Ollama를 실행하기 전에, 다음 단 한 번 명령으로 브라우저 접속을 허용하세요:

# Mac/Linux

OLLAMA_ORIGINS="*" ollama serve

# Windows (PowerShell)

$env:OLLAMA_ORIGINS="*"; ollama serve"port 11434 already in use" 오류가 나온다면? 이 뜻은 Ollama 앱이 백그라운드에서 이미 실행 중이라는 뜻입니다. Mac에서는 메뉴바에서 Ollama 아이콘을 찾아 종료(Quit)하고, Windows에서는 시스템 트레이에서 종료하세요. 그 후 위 명령을 다시 실행합니다.

2단계. Chrome 웹 스토어에서 SurfMind를 설치하고 아무 페이지에서나 열기.

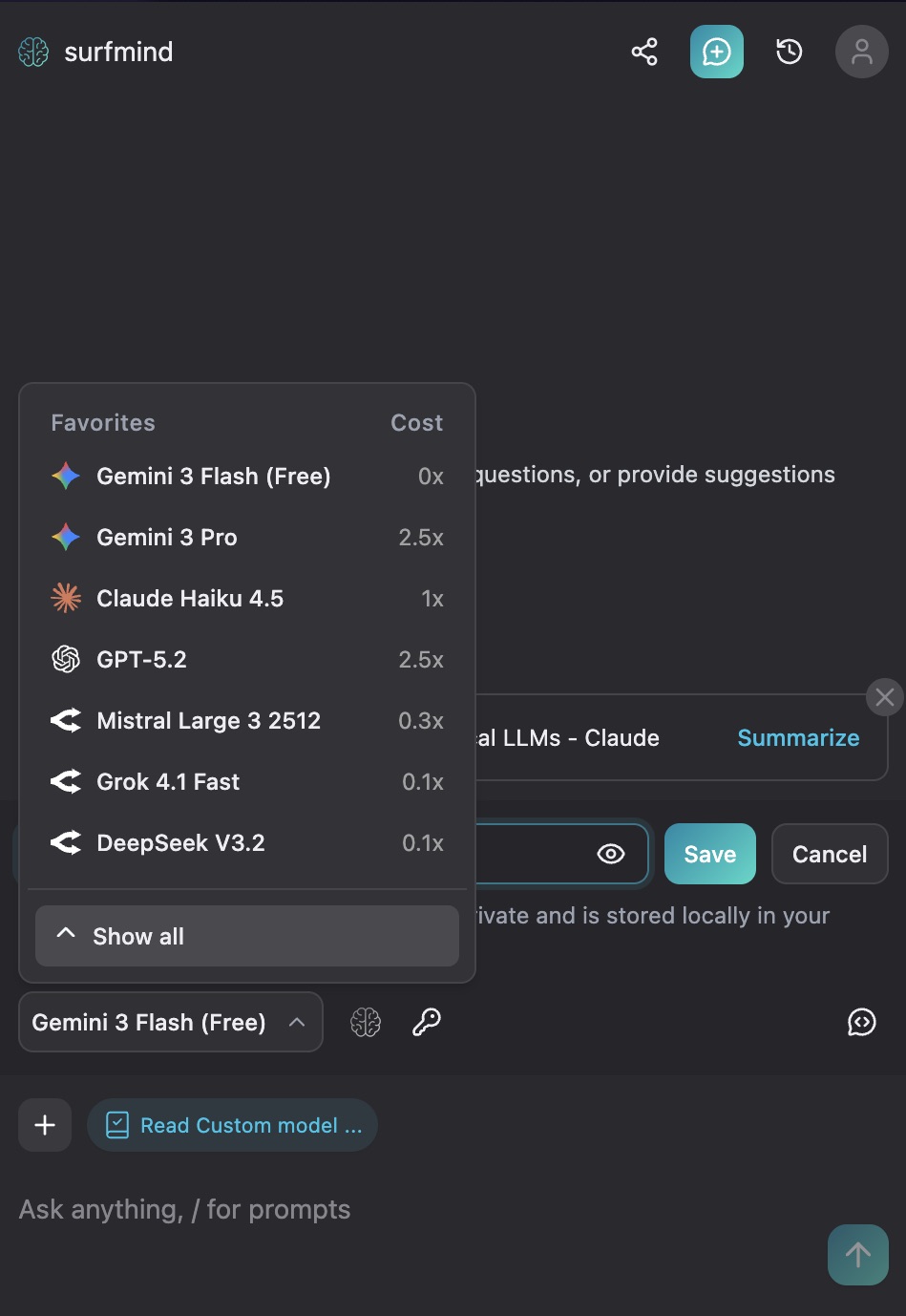

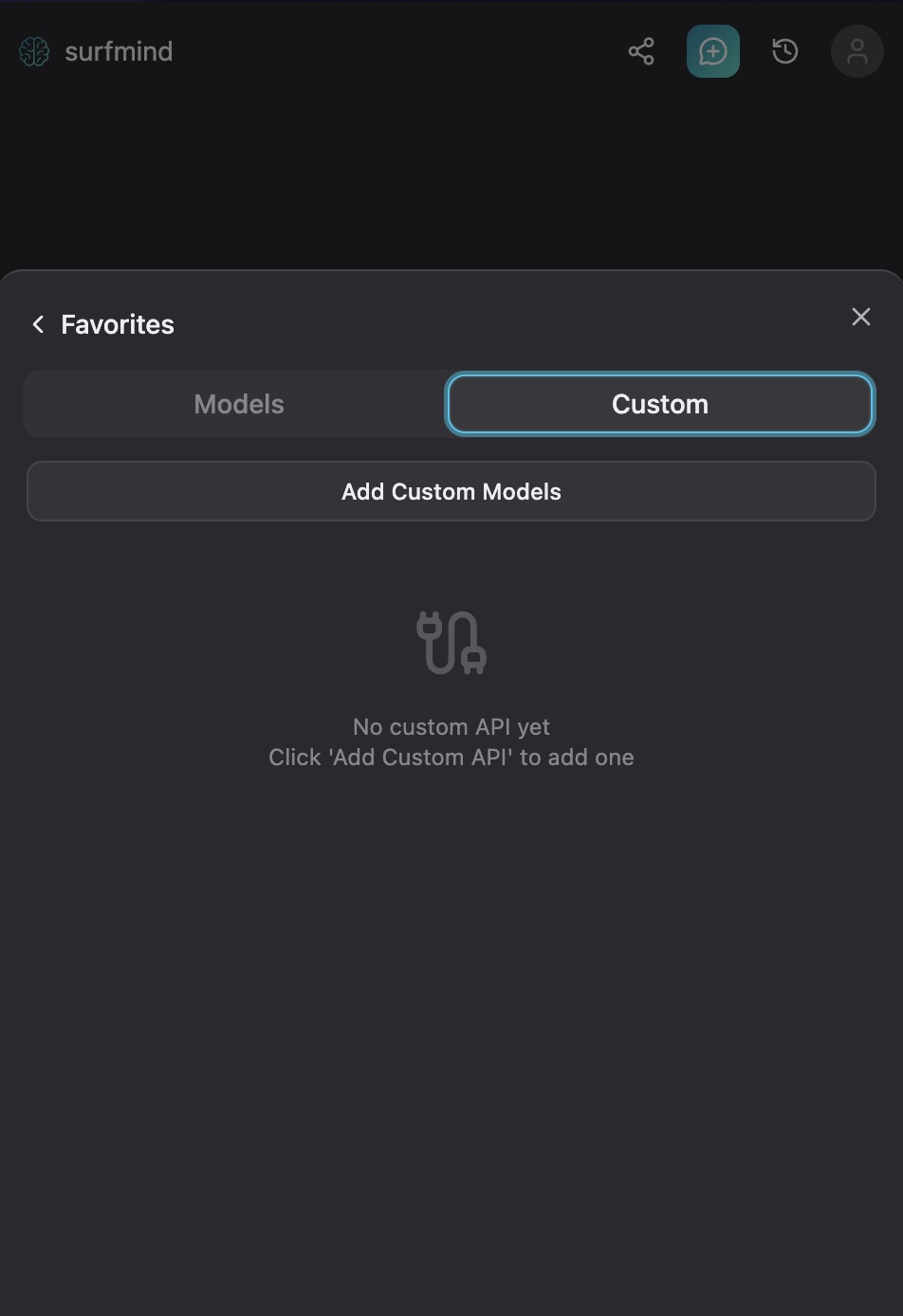

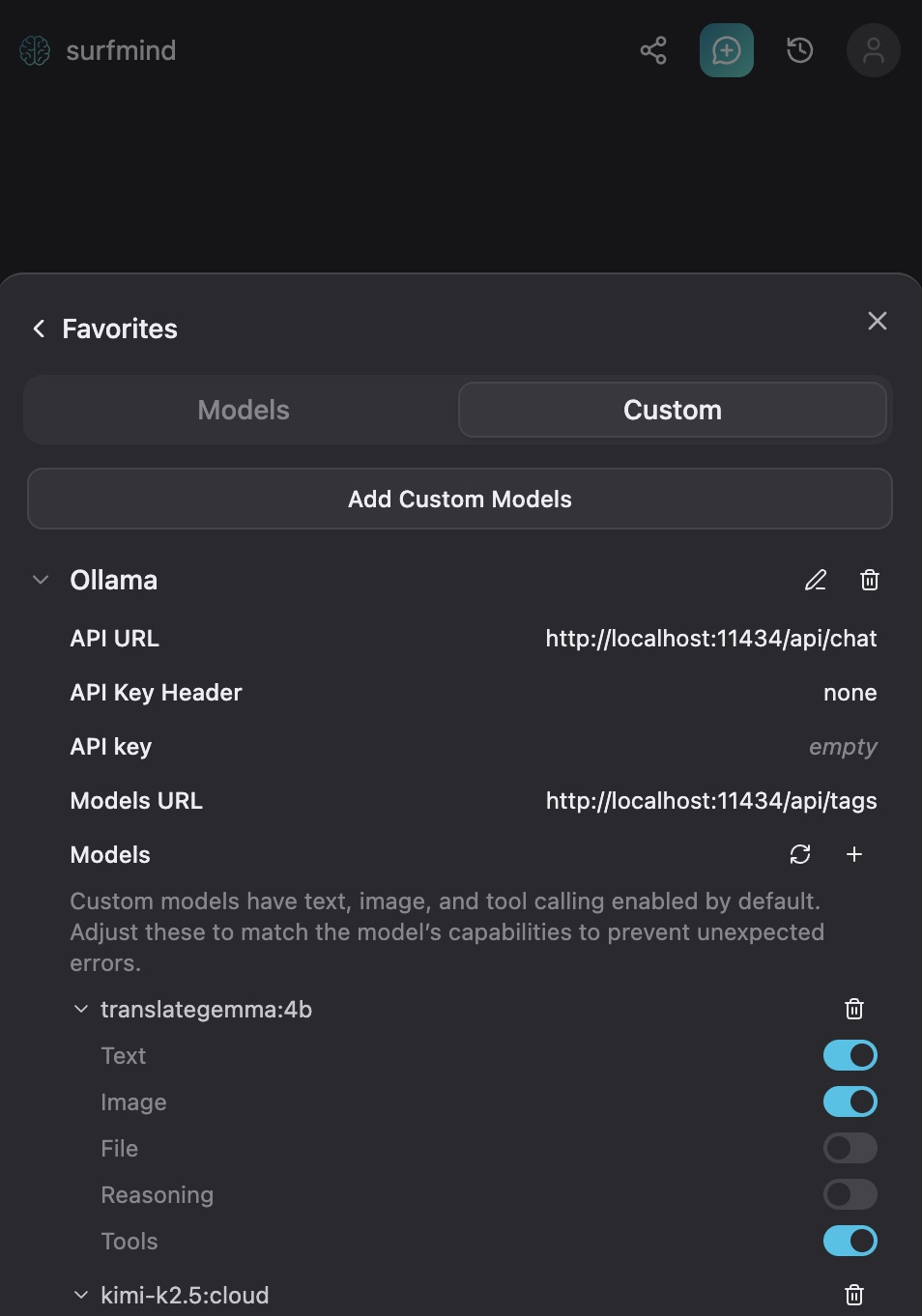

3단계. SurfMind 패널 하단에서 모델 이름을 클릭해 즐겨찾기를 열고, 사용자 지정(Custom) 탭으로 전환:

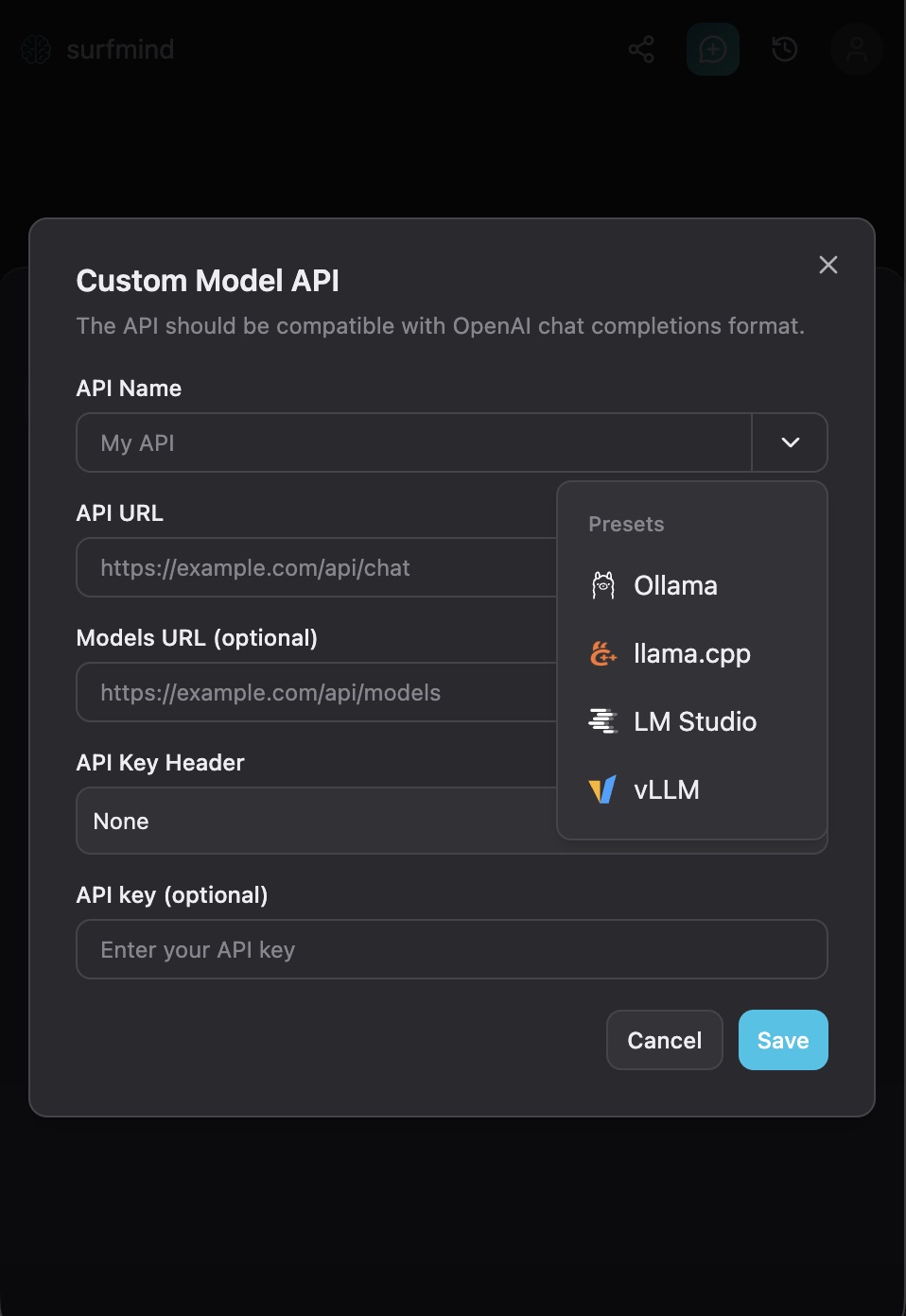

4단계. 사용자 지정 모델 추가(Add Custom Models) 클릭. '사용자 지정 모델 API' 폼이 나타납니다. API 이름 필드 옆의 드롭다운 화살표를 클릭하면 Ollama가 이미 프리셋으로 등록되어 있습니다. Ollama 선택하면 자동으로 필드가 채워집니다:

- API URL:

http://localhost:11434/api/chat - Models URL:

http://localhost:11434/api/tags - API Key Header: 없음

- API Key: 비워두기

5단계. 저장(Save) 클릭. SurfMind가 로컬 Ollama 인스턴스에 연결해 설치된 모델 목록을 불러옵니다. Ollama 섹션에 표시되어 선택할 수 있게 됩니다.

이제 아무 웹 페이지나 열고 SurfMind를 켠 뒤 하단 모델 선택기에서 Ollama 모델을 골라, 페이지 내용에 대해 질문을 시작하세요. 끝입니다.

시도해볼 만한 실용적 예제

연구원과 학생용: 학술 논문을 열고 “여기 주요 주장은 무엇인가?”, “저자들이 인정한 한계는 무엇인가?”라고 물어보세요. 전체 내용을 훑지 않고도 순식간에 방향을 잡을 수 있습니다.

개발자용: 현재 작업 중인 문서나 API 문서에서 구체적인 질문을 던져보세요. 생소한 API나 프레임워크를 거치는 데 훌륭한 도구입니다.

비즈니스용: 실적 보고서, 보도자료, 경쟁사 페이지, 업계 분석 등에 질문해 보세요. 눈에 띄는 점, 빠진 점, 의문점 등을 알 수 있습니다. 깊이 있는 분석이 필요하다면 클라우드 모델로 전환하세요.

프라이버시를 중시하는 일반 사용자용: 아무 때나 ChatGPT에 붙여넣기 전에 망설였던 텍스트를 대신 처리할 수 있습니다.

몇 가지 솔직한 주의사항

어떤 AI 도구도 완벽하지 않습니다. 모델은 때때로 자신감 넘치는 잘못된 답변을 내놓기도 합니다. 이는 모든 언어 모델의 한계이며 로컬 모델 한정 문제가 아닙니다. 법률 분석, 의학 질문, 금융 결정 같은 엄밀함이 요구되는 경우에는 결과물을 시작점으로 보고 반드시 검증해야 합니다.

그럼에도 품질은 크게 향상되었습니다. 작은 로컬 모델들도 대부분 일상 작업에 충분하며, 더 높은 성능이 필요하면 Ollama 클라우드 모델이 그 격차를 꽤 줄여줍니다.

한 번쯤은 써볼 가치가 있습니다

로컬 AI 환경은 대중이 생각하는 것보다 훨씬 빨리 발전했습니다. 1년 전만 해도 꽤 복잡한 기술적 준비가 필요했지만, 지금은 터미널 명령 두 번과 브라우저 확장 하나 설치만으로도 어디서든 프라이빗하게 무료 AI 조수를 쓸 수 있습니다.

직접 AI 환경을 꾸려보고 싶었지만 너무 어렵게 느껴졌다면 Ollama가 접근성을 제공할 것입니다. 오늘 오후에 설치하고 모델을 받아가세요. 다음에 읽으려던 기사에서 SurfMind를 열고 경험이 어떻게 달라지는지 확인해보세요.

만약 시도해보면, 어떤 용도로 사용하는지 알려주세요. 사용 사례는 늘 우리가 예상한 것보다 더 창의적입니다.

당신의 로컬 AI 모델이 작동 중입니다. 이제 방문하는 모든 페이지에서 유용하게 활용하세요.