Как использовать Ollama для общения с любой веб-страницей

Вы, наверное, заметили происходящие изменения. ChatGPT повсюду, но с ним растет и беспокойство. Что происходит с документами, которые вы вставляете? Кто читает ваши запросы? Может ли ваш работодатель или клиенты понять, что вы им пользовались?

Это справедливые вопросы. И есть растущее число людей, которые тихо перестали их задавать, потому что перенесли свою AI-систему локально.

Именно об этом этот пост. Мы пройдемся по Ollama: что это такое, как настроить, какие модели стоит использовать, а затем перейдем к по-настоящему захватывающей части — использованию ИИ прямо в браузере для взаимодействия с любой веб-страницей, которую вы читаете. Без подписок. Без передачи данных с вашего устройства, если вы этого не хотите.

Будь вы разработчиком, исследователем, журналистом или просто любознательным человеком, которому не нравится идея того, что каждый запрос где-то регистрируется, это для вас.

Прежде всего — что такое Ollama?

Ollama — это бесплатный, открытый инструмент, который позволяет скачивать и запускать большие языковые модели прямо на вашем компьютере. Mac, Windows, Linux — работает на всех.

Думайте о нем как о менеджере моделей. Вы выбираете модель, скачиваете ее один раз, и она полностью работает на вашем оборудовании с этого момента. Не нужен интернет, нет платежей за использование, и никакие третьи серверы не обрабатывают ваши запросы.

Когда ChatGPT впервые появился, мощные ИИ-модели были доступны лишь через облачные сервисы. Теперь вы можете запускать сопоставимые модели полностью локально и приватно или, если нужна большая мощность, использовать облако Ollama без смены инструментов и изменения рабочего процесса. Подробнее об этом чуть позже.

Практическая польза больше, чем кажется. Вы можете давать Ollama чувствительные документы, приватные заметки, конфиденциальные веб-страницы, и в зависимости от режима ничего из этого не покинет ваше устройство. Это также означает, что вы не платите за токены, которые тихо складываются в настоящие ежемесячные расходы.

Для чего на самом деле используют Ollama?

Прежде чем перейти к настройке, стоит опереться на реальные сценарии использования, потому что «запускать ИИ локально» может звучать абстрактно.

Люди используют локальные модели для удивительно широкого круга задач: суммирование длинных отчетов, написание электронных писем, отладка кода, исследование без сохранения запросов, анализ контрактов, обработка заметок с встреч. Разработчики используют их для тестирования поведения моделей в контролируемой среде. Писатели — чтобы получить обратную связь по черновикам, не опасаясь, что их работа пойдет в данные для обучения. Студенты — чтобы разбираться в сложных темах, не тратя подписку.

Общее — контроль. Те, кто пользуются Ollama, хотят работать с ИИ на своих условиях, а не через подписные порталы, которые могут менять цены, ограничивать скорость или логировать сессии.

Настройка Ollama

Что понадобится

Не нужен супермощный компьютер, но RAM важна. Рекомендуется минимум 16 ГБ для плавной работы с большинством моделей. 8 ГБ технически достаточно, но вас ограничат самые маленькие модели, а отклики могут быть медленными. Если у вас Mac на Apple Silicon — особенно хорошо, благодаря унифицированной памяти, которая эффективно работает с локальными ИИ. Windows и Linux тоже отлично подходят.

Установка

Ollama поддерживает основные платформы (macOS, Linux, Windows). Самый простой способ установить:

# On macOS or Linux

curl -fsSL https://ollama.com/install.sh | sh

# Or use Homebrew on macOS

brew install ollama

# On Windows, download the installer from Ollama’s website https://ollama.com/download/windowsПосле установки Ollama запускает локальный сервер на порту 11434. Проверьте работу, открыв в браузере http://localhost:11434 — вы должны увидеть сообщение-подтверждение.

Загрузите свою первую модель

Откройте терминал и выполните:

ollama pull llama3.2Это скачает модель Meta Llama 3.2 (~2 ГБ) на ваш компьютер. Команда run автоматически скачает модель, если перейти сразу к:

ollama run llama3.2Задайте вопрос. Получите ответ. Теперь вы запускаете мощную языковую модель полностью на своем оборудовании.

Какую модель выбрать?

В библиотеке Ollama более 100 моделей, что сначала может сбивать с толку. Вот практическая отправная точка:

| Модель | Для чего подходит | Требуемая RAM |

|---|---|---|

gemma3:2b |

Старые или слабые компьютеры | ~4 ГБ |

llama3.2 |

Общие повседневные задачи | ~8 ГБ |

mistral |

Быстродействие и программирование | ~8 ГБ |

deepseek-r1 |

Анализ, рассуждения, исследования | ~8 ГБ |

llama3.3:70b |

Максимальные локальные возможности | ~32 ГБ+ |

Если вы только начинаете, выбирайте llama3.2. Она быстрая, универсальная и с комфортом работает на большинстве современных ноутбуков.

Проверьте список установленных моделей командой:

ollama listВажно: эти модели имеют дату отсечения знаний и не имеют доступа к живым данным. Для реального времени, например, веб-страницы, которую вы читаете, нужно напрямую предоставлять им контекст. Именно к этому мы и движемся.

А что если нужна более мощная модель?

Локальные модели впечатляют, но ограничены вашим оборудованием. Модель с 70 миллиардами параметров требует серьезной RAM. Модель с 671 миллиардом параметров просто не запустится на домашнем компьютере.

Здесь на помощь приходят облачные модели Ollama. Выпущенные в конце 2025 года, они позволяют запускать огромные модели на оборудовании уровня дата-центров, используя тот же интерфейс Ollama, который вы уже знаете. Те же команды, тот же API, те же инструменты.

ollama run deepseek-v3.1:671b-cloudДоступные облачные модели:

deepseek-v3.1:671b-cloud: одна из самых мощных открытых моделейqwen3-coder:480b-cloud: специализирована на программированииgpt-oss:120b-cloudиgpt-oss:20b-cloud: открытые модели OpenAI

Облачные модели работают точно так же, как и локальные. Единственное отличие — нужна авторизация на ollama.com:

ollama signinИ важно: в облаке Ollama ваши данные не сохраняются. Вы получаете мощь больших облачных моделей без обычных компромиссов по приватности.

Практическая рекомендация: используйте локальные модели для чувствительной работы, где данные никуда не должны уходить. Переключайтесь на облачные, когда нужна максимальная мощность. Ollama делает это бесшовно — просто выбирайте модель с суффиксом -cloud.

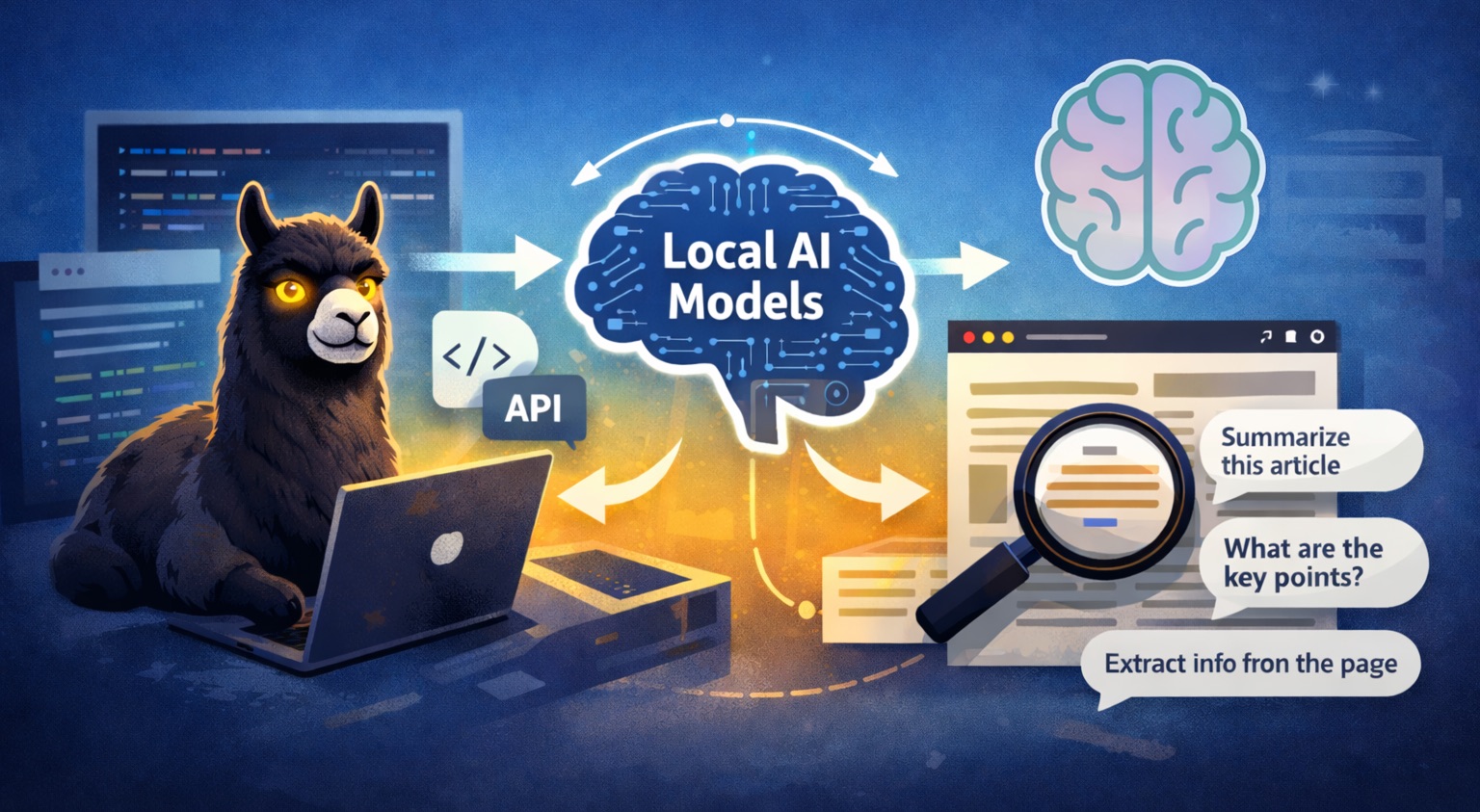

Часть, которая действительно меняет работу: чат с веб-страницами

Вот где начинается самое интересное.

Ollama сам по себе полезен. Но соединить его с браузером, чтобы можно было направить на любую веб-страницу и задавать вопросы по содержимому, — вот здесь рабочий процесс меняется с «классного эксперимента» в инструмент, к которому вы будете обращаться ежедневно.

Подумайте, что это открывает:

- Читаете сложную исследовательскую статью? Попросите модель суммировать методологию, объяснить выводы простыми словами или указать на спорные моменты.

- Смотрите страницу с ценами конкурентов? Узнайте, чем они отличаются или что явно упущено.

- Читаете длинную новостную статью? Получите ключевые утверждения, проверьте соответствие заголовка содержимому, услышите контраргумент.

- Просматриваете вакансию? Спросите, действительно ли ваш опыт совпадает с описанным.

- Работаете с юридическим документом или условиями обслуживания? Получите понятное объяснение без необходимости вставлять чувствительный текст в облачный сервис.

Все по вашим правилам. Контент страницы подается выбранной модели.

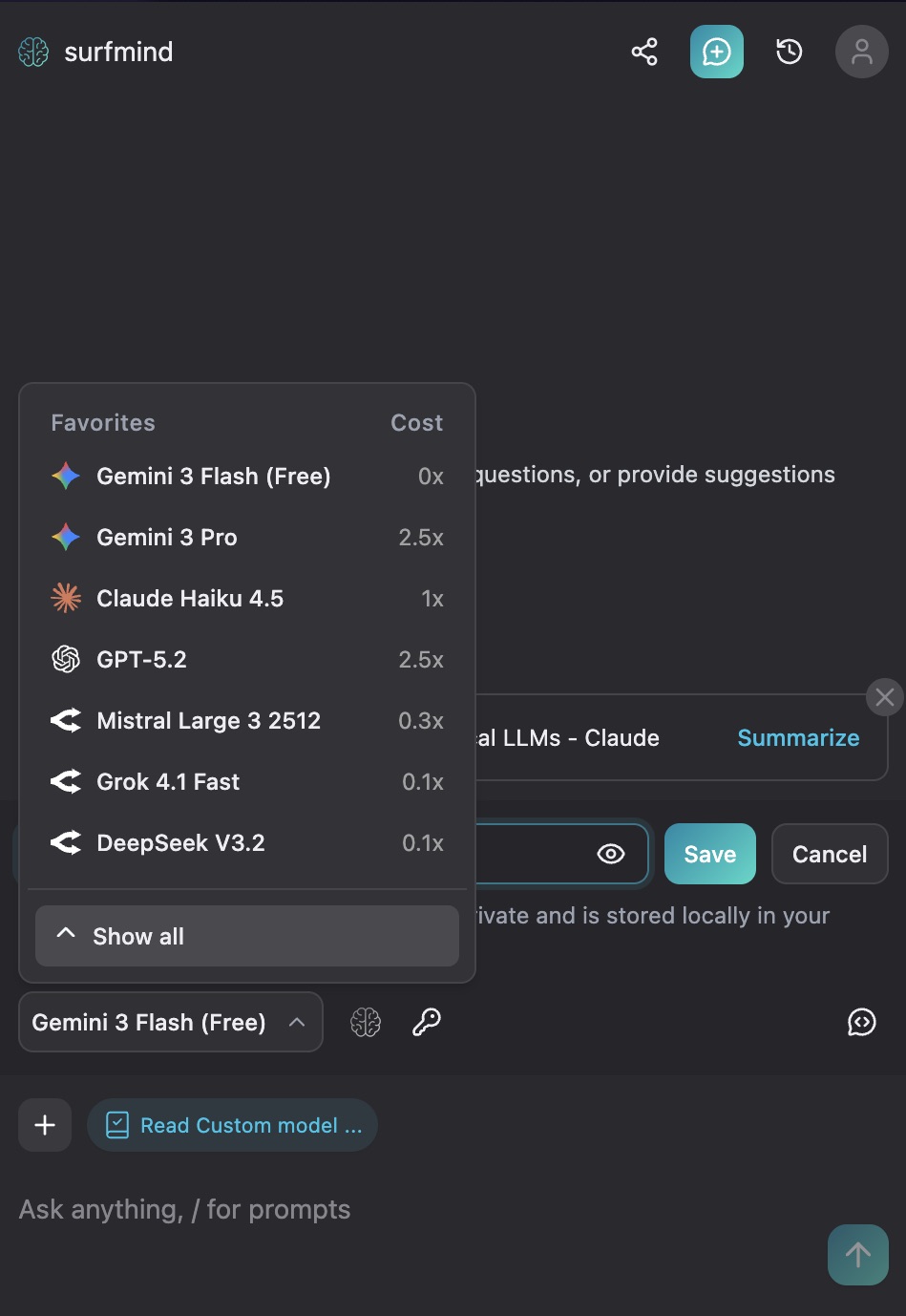

Как это делать с SurfMind

SurfMind — браузерное расширение, созданное именно для этого. Оно читает содержимое текущей страницы и позволяет вести настоящий диалог с ним прямо в браузере без копирования и вставки.

Поддерживает локальные модели Ollama из коробки, а также облачные модели Ollama и дает вам мощного AI-помощника, который работает по всему вебу на ваших условиях.

Инструкция подключения:

Шаг 1. Перед запуском Ollama включите доступ из браузера одной командой:

# Mac/Linux

OLLAMA_ORIGINS="*" ollama serve

# Windows (PowerShell)

$env:OLLAMA_ORIGINS="*"; ollama serveОшибка «порт 11434 уже используется»? Значит, приложение Ollama уже запущено в фоне. Сначала закройте его: на Mac щелкните иконку Ollama в строке меню и выберите Quit; на Windows — найдите его в трее. Затем выполните команду снова.

Шаг 2. Установите SurfMind из Chrome Web Store и откройте расширение на любой странице.

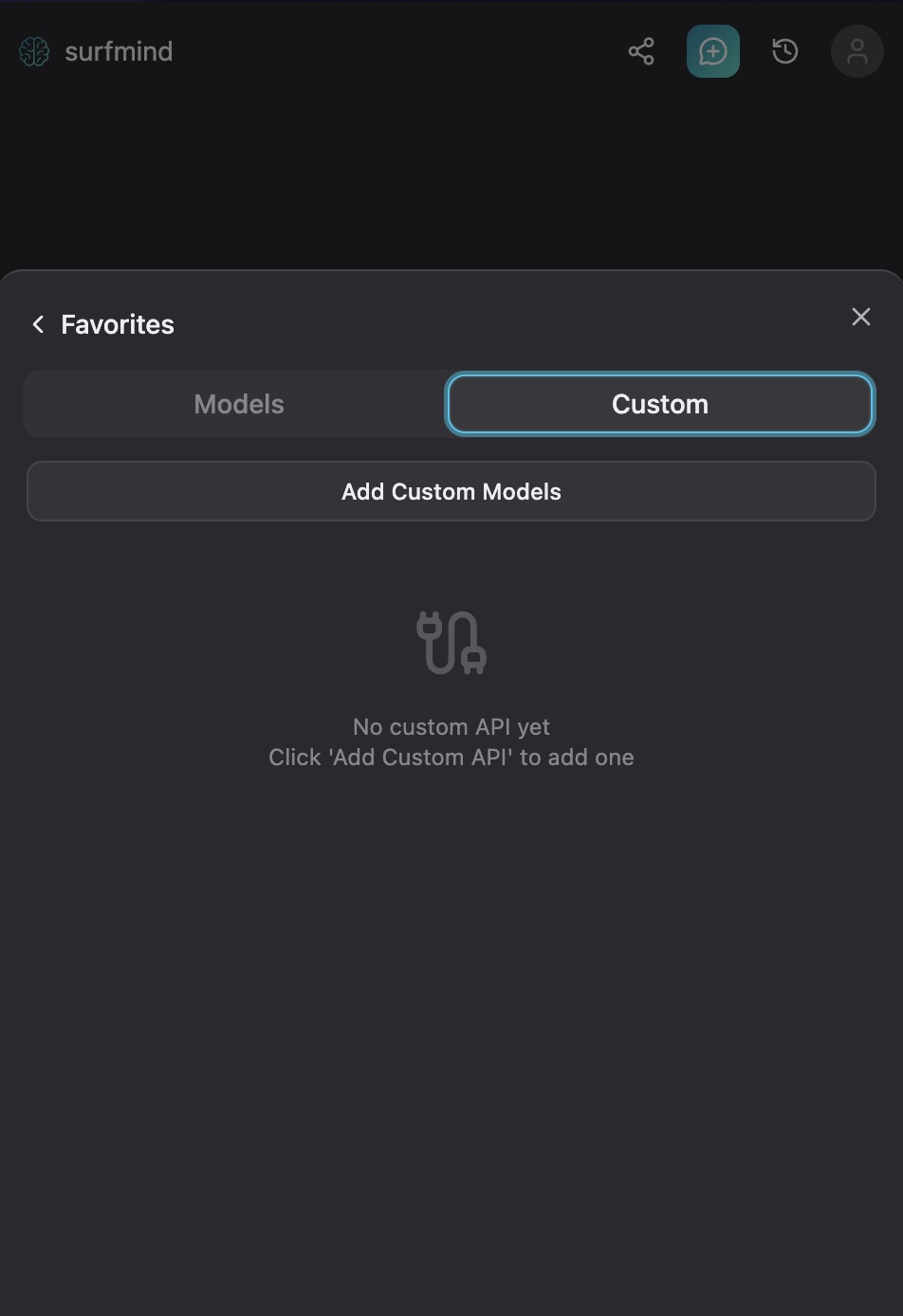

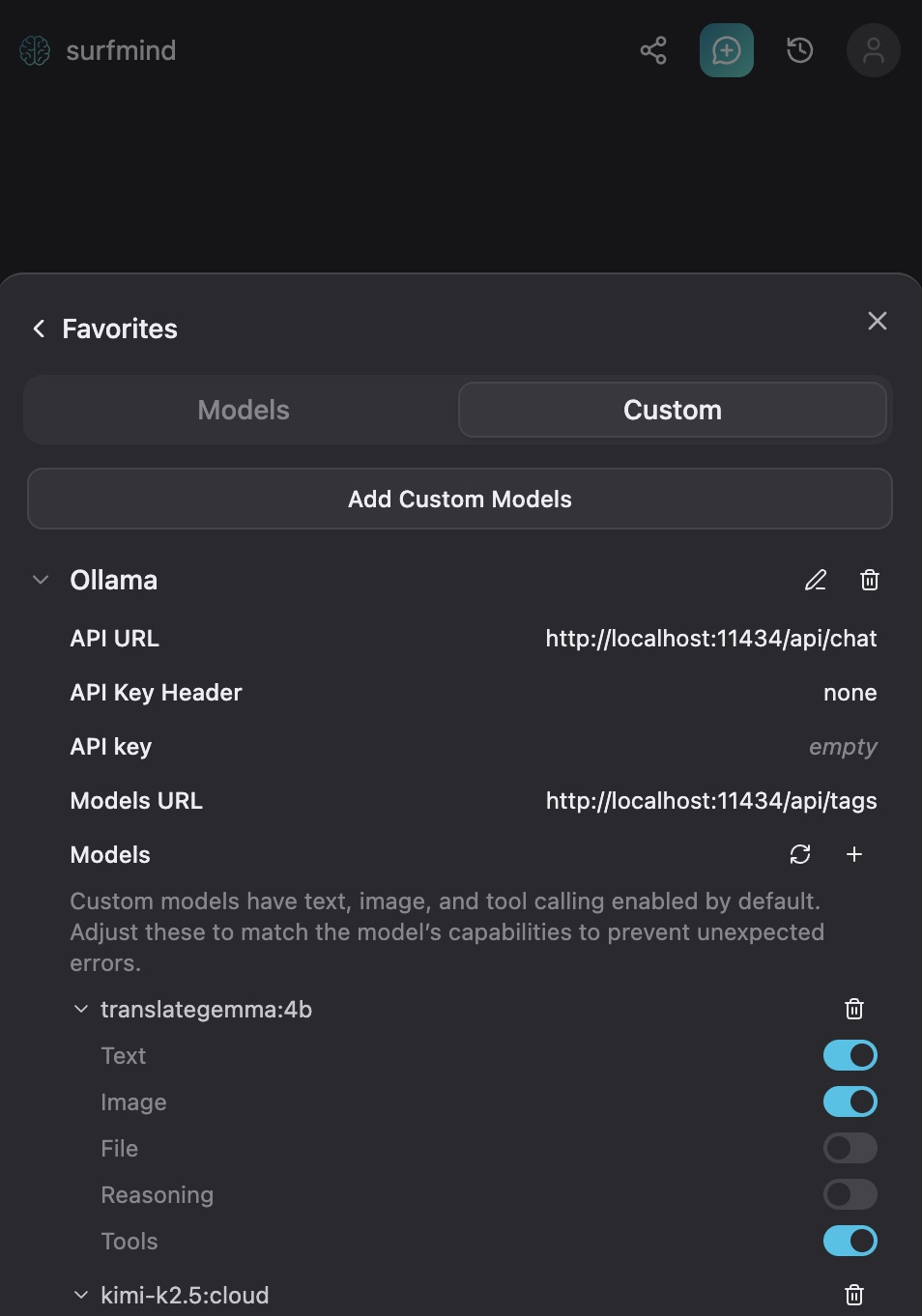

Шаг 3. Кликните на имя модели внизу панели SurfMind, чтобы открыть Избранное, затем переключитесь на вкладку Custom.

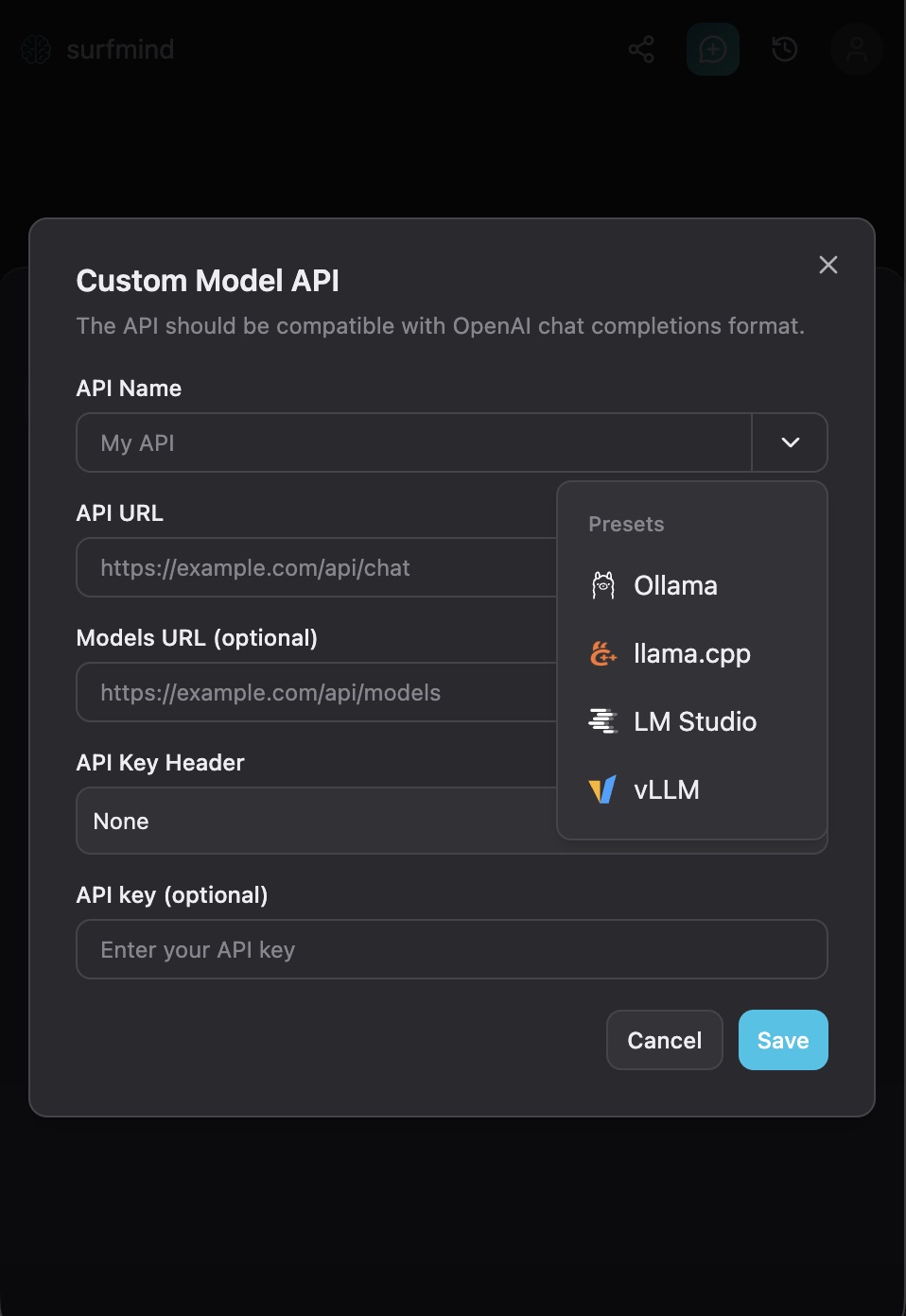

Шаг 4. Нажмите Add Custom Models. Появится форма «Custom Model API». Кликните стрелку рядом с полем API Name — выпадет меню Presets, где уже будет Ollama. Выберите Ollama — поля заполнится автоматически:

- API URL:

http://localhost:11434/api/chat - Models URL:

http://localhost:11434/api/tags - API Key Header: Нет

- API Key: (оставьте пустым)

Шаг 5. Нажмите Save. SurfMind подключится к вашей локальной инстанции Ollama и загрузит список установленных моделей. Они появятся в разделе Ollama, готовые к выбору.

Теперь откройте любую веб-страницу, откройте SurfMind, выберите модель Ollama внизу и начинайте задавать вопросы по содержимому страницы. Вот и всё.

Практические примеры для проб

Для исследователей и студентов: Откройте любую научную статью и спросите «каков главный аргумент?» или «какие ограничения признают авторы?». Вы ориентируетесь в тексте за секунды, а не пролистываете весь материал в поисках нужного.

Для разработчиков: Откройте документацию и задавайте конкретные вопросы. Отлично подходит для работы с незнакомыми API или фреймворками без необходимости переключаться в другое окно.

Для бизнеса: Показывайте отчеты о доходах, пресс-релизы, страницы конкурентов или отраслевой анализ. Спрашивайте, что выделяется, что упущено, и какие вопросы возникают. Для глубокого анализа переключайтесь на облачные модели.

Для тех, кто заботится о приватности: Каждый раз, когда вы обычно боялись вставлять что-то в ChatGPT из-за конфиденциальности, здесь есть альтернатива.

Несколько честных предупреждений

Нет ни одного AI-инструмента без ошибок. Модели могут уверенно выдавать неправильные ответы. Это ограничение всех языковых моделей, а не только локальных. По вопросам, требующим точности — юридическим, медицинским, финансовым — воспринимайте выводы как основу для проверки, а не как окончательный ответ.

Тем не менее, качество сильно выросло. Малые локальные модели хорошо справляются с большинством повседневных задач, а облачные модели Ollama сильно приближаются к самим мощным.

Стоит попробовать, хотя бы один раз

Локальная AI-среда развивалась быстрее, чем многие думают. Еще год назад для этого требовались большие технические усилия. Сегодня вас отделяет всего пара команд в терминале и одно расширение для браузера, чтобы получить мощного AI-помощника, работающего с любой веб-страницей приватно, бесплатно и полностью на ваших условиях.

Если вам было интересно настроить свой собственный AI, но казалось слишком сложно, Ollama — это то, что сделает этот путь доступным. Установите ее сегодня. Скачайте модель. Откройте SurfMind на следующей статье, которую собирались читать. Посмотрите, как это изменит ваш опыт.

И если попробуете, расскажите нам, для чего вы будете его использовать. Пользовательские сценарии всегда оказываются гораздо более креативными, чем мы могли представить.

Ваш локальный AI-модель запущена. Теперь примените ее на каждой странице, которую просматриваете.