Cách Sử Dụng Ollama để Trò Chuyện với Bất Kỳ Trang Web Nào

Bạn có thể đã chú ý đến sự thay đổi đang diễn ra. ChatGPT xuất hiện ở khắp mọi nơi, nhưng cũng có sự lo ngại ngày càng tăng xung quanh nó. Những tài liệu bạn dán vào sẽ ra sao? Ai đọc các câu hỏi bạn gửi? Nhà tuyển dụng hay khách hàng của bạn có thể biết khi nào bạn đang sử dụng nó không?

Đó là những câu hỏi hợp lý. Và có một nhóm người ngày càng nhiều đã lặng lẽ ngừng đặt ra vì họ đã chuyển thiết lập AI sang chạy cục bộ.

Đây chính là chủ đề của bài viết này. Chúng ta sẽ đi qua Ollama, nó là gì, cách cài đặt, những mô hình nào đáng dùng, rồi đến phần thật sự thú vị: dùng AI trực tiếp trong trình duyệt để tương tác với bất kỳ trang web nào bạn đang đọc. Không cần đăng ký. Không dữ liệu nào rời khỏi máy bạn trừ khi bạn muốn.

Dù bạn là nhà phát triển, nhà nghiên cứu, nhà báo hay chỉ đơn thuần là người tò mò về AI và không thích việc mọi truy vấn của mình bị ghi lại đâu đó, đây là dành cho bạn.

Trước tiên - Ollama là gì?

Ollama là một công cụ miễn phí, mã nguồn mở cho phép bạn tải xuống và chạy các mô hình ngôn ngữ lớn trực tiếp trên máy tính của bạn. Mac, Windows, Linux, đều hỗ trợ.

Hãy nghĩ nó như một trình quản lý mô hình. Bạn chọn một mô hình, tải về một lần, và từ đó nó chạy hoàn toàn trên phần cứng của bạn. Không cần kết nối internet. Không mất phí sử dụng. Không có máy chủ bên thứ ba xử lý truy vấn của bạn.

Khi ChatGPT mới ra mắt, các mô hình AI mạnh chỉ có thể truy cập qua các dịch vụ đám mây. Giờ bạn có thể chạy những mô hình tương đương hoàn toàn cục bộ và riêng tư, hoặc nếu cần sức mạnh, kết nối vào đám mây của Ollama mà không phải chuyển công cụ hay thay đổi workflow. Sẽ nói kỹ hơn ngay sau.

Lợi ích thực tế lớn hơn bạn tưởng. Bạn có thể đưa cho Ollama những tài liệu nhạy cảm, ghi chú riêng tư, trang web bí mật, và tùy chế độ dùng, chẳng cần dữ liệu nào đi nơi khác. Đồng thời bạn không phải trả phí tính theo token, vốn âm thầm cộng dồn thành chi phí hàng tháng.

Mọi người dùng Ollama để làm gì?

Trước khi cài đặt, hãy điểm qua vài trường hợp sử dụng thực tế, vì "chạy AI cục bộ" nghe có vẻ trừu tượng.

Mọi người dùng mô hình cục bộ cho rất nhiều việc: tóm tắt báo cáo dài, soạn email, gỡ lỗi code, nghiên cứu mà không muốn truy vấn bị lưu, phân tích hợp đồng, xử lý ghi chú cuộc họp. Lập trình viên dùng nó để kiểm thử hành vi mô hình trong môi trường kiểm soát. Nhà văn dùng để nhận phản hồi bản thảo mà không lo bị dùng làm dữ liệu huấn luyện. Sinh viên dùng để giải quyết chủ đề khó mà không vội tốn phí đăng ký.

Điểm chung là kiểm soát. Người dùng Ollama thường muốn làm việc với AI theo cách riêng của họ, không qua cổng đăng ký dễ bị thay đổi giá cả, giới hạn truy cập hay lưu trữ phiên làm việc.

Cài đặt Ollama

Bạn cần chuẩn bị gì

Bạn không cần máy tính khủng, nhưng RAM quan trọng. Chúng tôi khuyến nghị ít nhất 16GB để trải nghiệm mượt với đa số mô hình. 8GB vẫn chạy được nhưng chỉ với các mô hình nhỏ nhất và thời gian phản hồi sẽ hơi chậm. Nếu bạn dùng Mac có Apple Silicon, rất lợi thế vì kiến trúc bộ nhớ thống nhất xử lý AI cục bộ hiệu quả. Windows và Linux cũng chạy rất tốt.

Cài đặt

Ollama hỗ trợ các nền tảng chính (macOS, Linux, Windows). Cách cài dễ nhất:

# On macOS or Linux

curl -fsSL https://ollama.com/install.sh | sh

# Or use Homebrew on macOS

brew install ollama

# On Windows, download the installer from Ollama’s website https://ollama.com/download/windowsSau khi cài xong, Ollama chạy một server cục bộ nền ở cổng 11434. Bạn có thể kiểm tra bằng cách mở trình duyệt vào http://localhost:11434, sẽ thấy thông báo xác nhận.

Tải mô hình đầu tiên

Mở terminal và chạy:

ollama pull llama3.2Lệnh này tải về mô hình Llama 3.2 của Meta (~2GB). Lệnh run cũng tự động tải nếu bạn bỏ qua giai đoạn trên và chạy luôn:

ollama run llama3.2Gõ câu hỏi rồi nhận câu trả lời. Bạn đã chạy được một mô hình ngôn ngữ mạnh mẽ hoàn toàn trên phần cứng của mình.

Nên dùng mô hình nào?

Thư viện Ollama có hơn 100 mô hình, ban đầu dễ khiến bạn bối rối. Đây là lựa chọn thực tế:

| Mô hình | Phù hợp với | RAM cần |

|---|---|---|

gemma3:2b |

Máy yếu hoặc đời cũ | ~4GB |

llama3.2 |

Dùng hàng ngày đa năng | ~8GB |

mistral |

Nhanh, xử lý mã lập trình | ~8GB |

deepseek-r1 |

Phân tích, suy luận, nghiên cứu | ~8GB |

llama3.3:70b |

Công suất cục bộ tối đa | ~32GB+ |

Nếu mới bắt đầu, llama3.2 là lựa chọn tốt. Nhanh, đa dụng, chạy thoải mái trên hầu hết laptop hiện nay.

Xem danh sách mô hình đã cài:

ollama listLưu ý: các mô hình này có giới hạn kiến thức đến một mốc nhất định và không truy cập dữ liệu trực tuyến. Với nội dung thời gian thực như trang web bạn đang đọc, bạn phải cung cấp bối cảnh trực tiếp cho chúng. Đây chính là điều chúng ta sẽ phát triển.

Nếu cần mô hình lớn mạnh hơn?

Mô hình cục bộ rất ấn tượng, nhưng giới hạn bởi phần cứng của bạn. Mô hình 70 tỷ tham số cần RAM rất lớn, còn loại 671 tỷ tham số thì không thể chạy trên máy cá nhân.

Đây chính là lúc các mô hình đám mây của Ollama phát huy tác dụng. Ra mắt cuối 2025, cho phép bạn chạy các mô hình khổng lồ trên phần cứng cấp trung tâm dữ liệu với giao diện Ollama quen thuộc. Cùng lệnh, cùng API, cùng công cụ.

ollama run deepseek-v3.1:671b-cloudCác mô hình đám mây có:

deepseek-v3.1:671b-cloud: một trong những mô hình mở mạnh nhất hiện cóqwen3-coder:480b-cloud: chuyên cho lập trìnhgpt-oss:120b-cloudvàgpt-oss:20b-cloud: mô hình mở của OpenAI

Mô hình đám mây hoạt động kiểu như mô hình cục bộ, chỉ khác bạn cần đăng nhập ollama.com trước:

ollama signinVà quan trọng: Ollama đám mây không lưu giữ dữ liệu của bạn. Bạn nhận sức mạnh của các mô hình lớn mà không mất quyền riêng tư.

Điểm lợi: dùng mô hình cục bộ cho công việc nhạy cảm, không muốn dữ liệu rời máy. Chuyển sang đám mây khi cần hiệu suất tối đa. Ollama hỗ trợ cả hai liền mạch, bạn chỉ cần chọn tag mô hình có hậu tố -cloud.

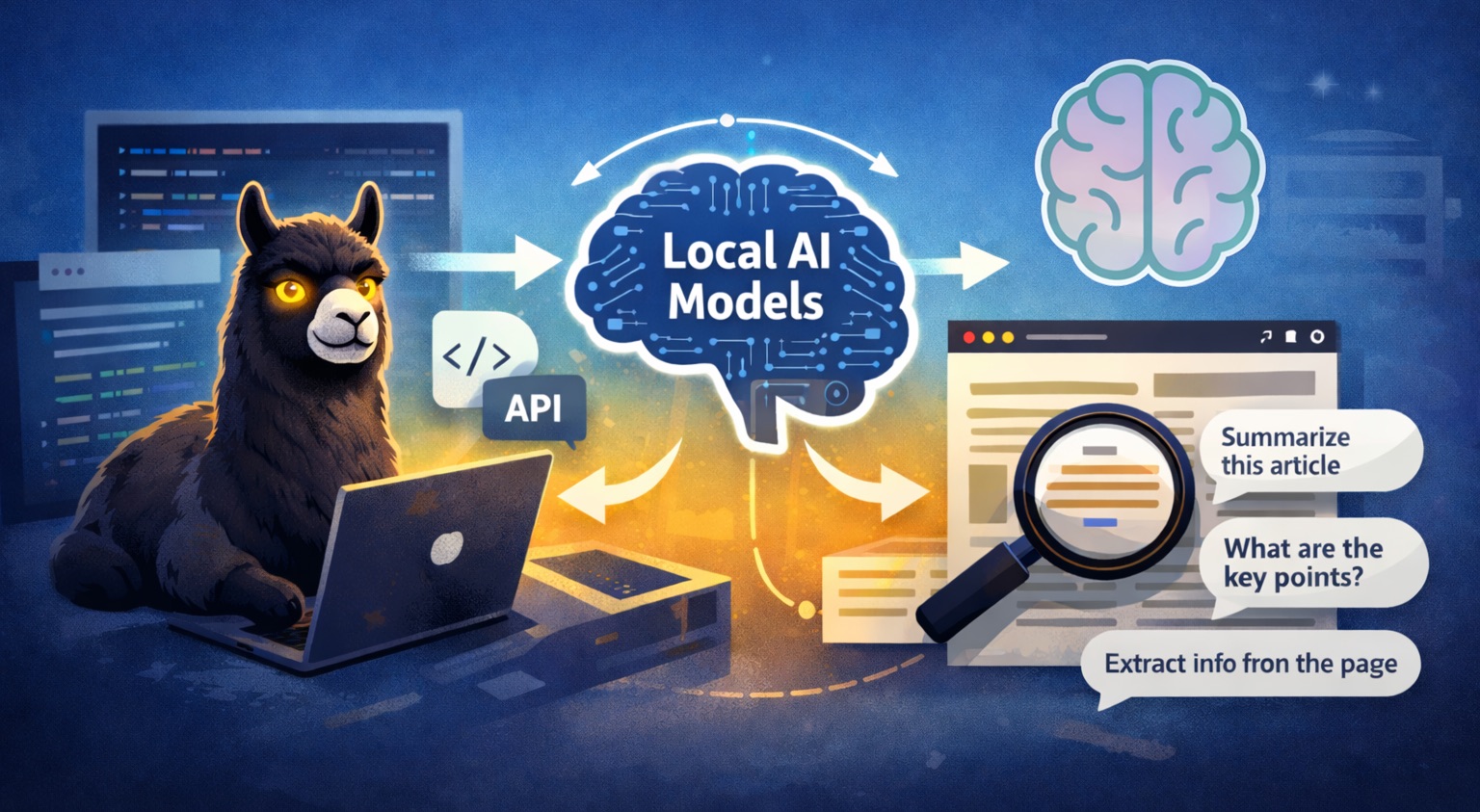

Phần thay đổi cách bạn làm việc: trò chuyện với trang web

Đây là phần thú vị nhất.

Ollama tự nó đã hữu ích. Nhưng kết nối vào trình duyệt, để bạn có thể chỉ vào bất cứ trang web nào và hỏi trực tiếp về nội dung hiển thị, mới là bước chuyển từ "thí nghiệm hay ho" thành công cụ bạn sẽ dùng hàng ngày.

Nghĩ về những gì điều này mở ra:

- Đọc bài nghiên cứu dày? Hỏi mô hình tóm tắt phương pháp, giải thích kết quả bằng ngôn ngữ đơn giản, hoặc chỉ ra chỗ nào có vẻ không hợp lý.

- Xem trang giá của đối thủ? Hỏi điểm khác biệt chính, hoặc yếu tố thiếu sáng rõ.

- Đọc bài báo dài? Lấy ra những luận điểm chính, kiểm tra tiêu đề có phù hợp không, nghe phản biện.

- Xem tin tuyển dụng? Hỏi liệu kinh nghiệm của bạn có phù hợp với mô tả không.

- Đọc tài liệu pháp lý hoặc điều khoản dịch vụ? Nhận bản giải thích rõ ràng mà không phải dán văn bản nhạy cảm lên công cụ đám mây.

Tất cả theo đúng điều kiện của bạn. Nội dung trang web sẽ được gửi đến mô hình bạn chọn.

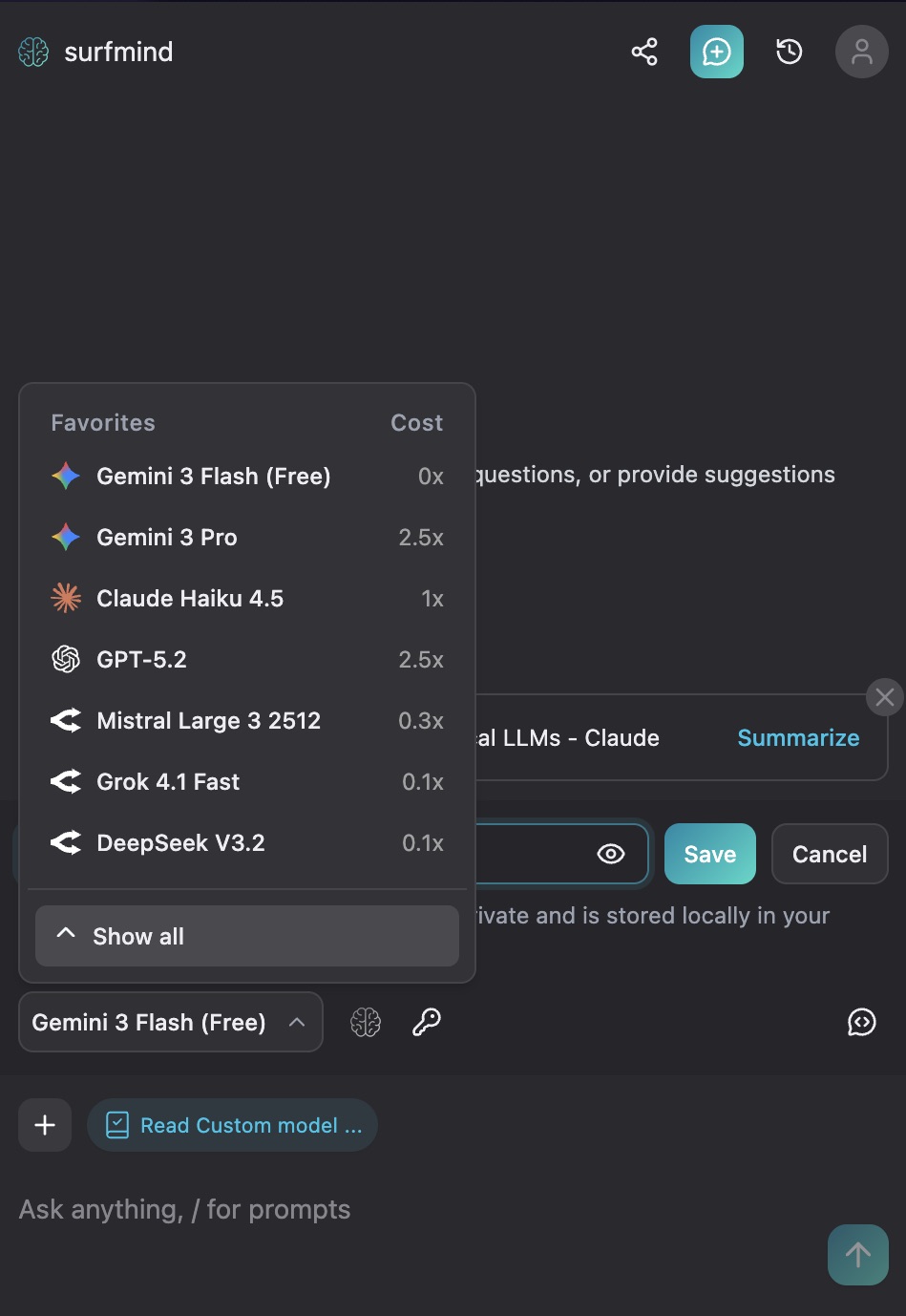

Cách làm với SurfMind

SurfMind là tiện ích trình duyệt được tạo ra cho mục đích này. Nó đọc nội dung trang bạn đang xem và cho phép bạn trò chuyện cùng nó trực tiếp trong trình duyệt, không cần sao chép dán.

Nó hỗ trợ mô hình Ollama cục bộ ngay khi cài, cũng như mô hình đám mây Ollama, đem đến trợ lý AI mạnh mẽ giúp bạn làm việc trên toàn bộ web theo cách riêng.

Cách kết nối:

Bước 1. Trước khi chạy Ollama, bật truy cập trình duyệt với lệnh một lần này:

# Mac/Linux

OLLAMA_ORIGINS="*" ollama serve

# Windows (PowerShell)

$env:OLLAMA_ORIGINS="*"; ollama serveLỗi "port 11434 already in use"? Có nghĩa là Ollama đã chạy ngầm. Thoát ứng dụng trước, trên Mac tìm biểu tượng Ollama trên thanh menu rồi chọn Quit; trên Windows vào khay hệ thống để tắt. Rồi chạy lại lệnh trên.

Bước 2. Cài SurfMind từ Chrome Web Store và mở nó trên bất kỳ trang nào.

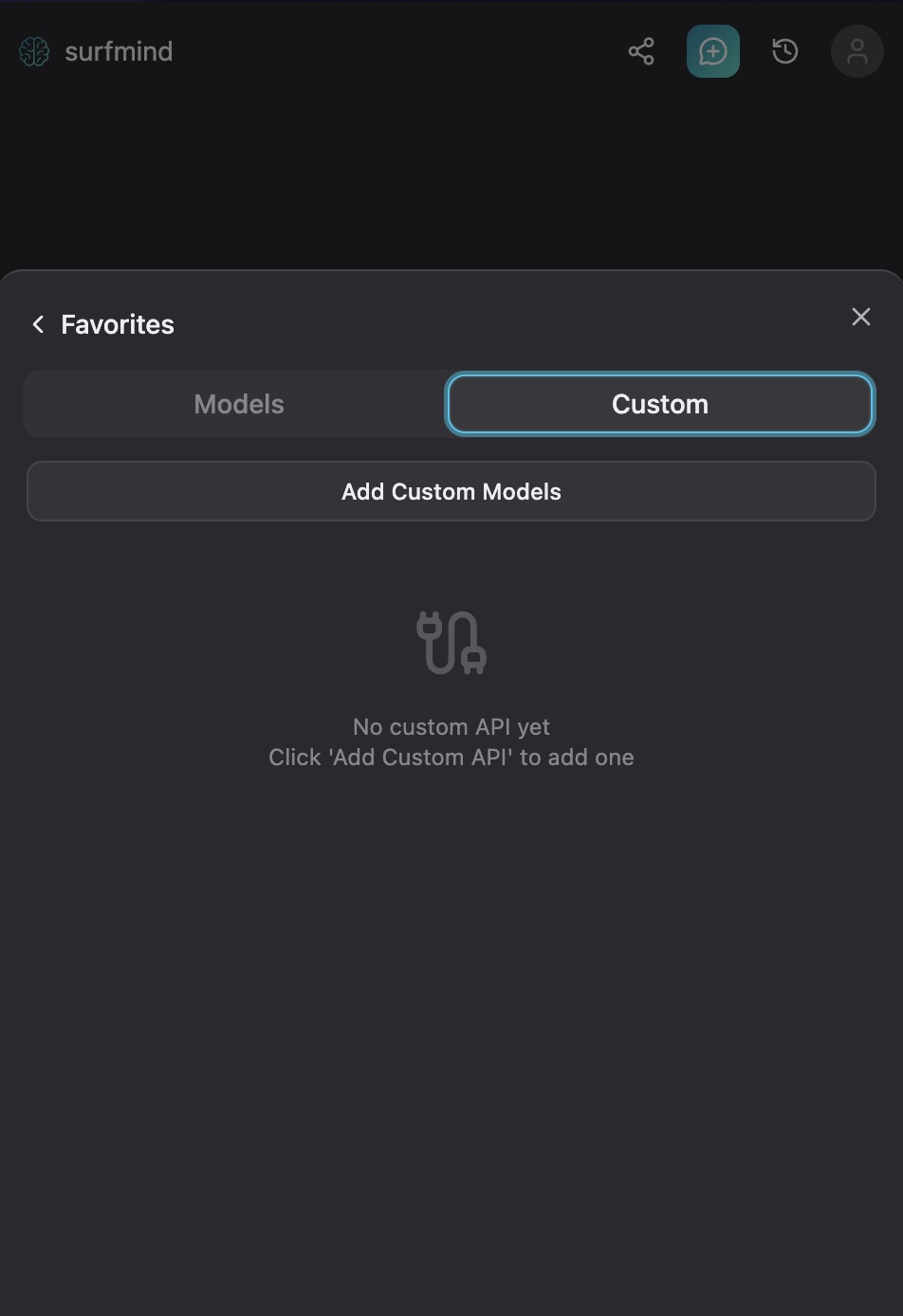

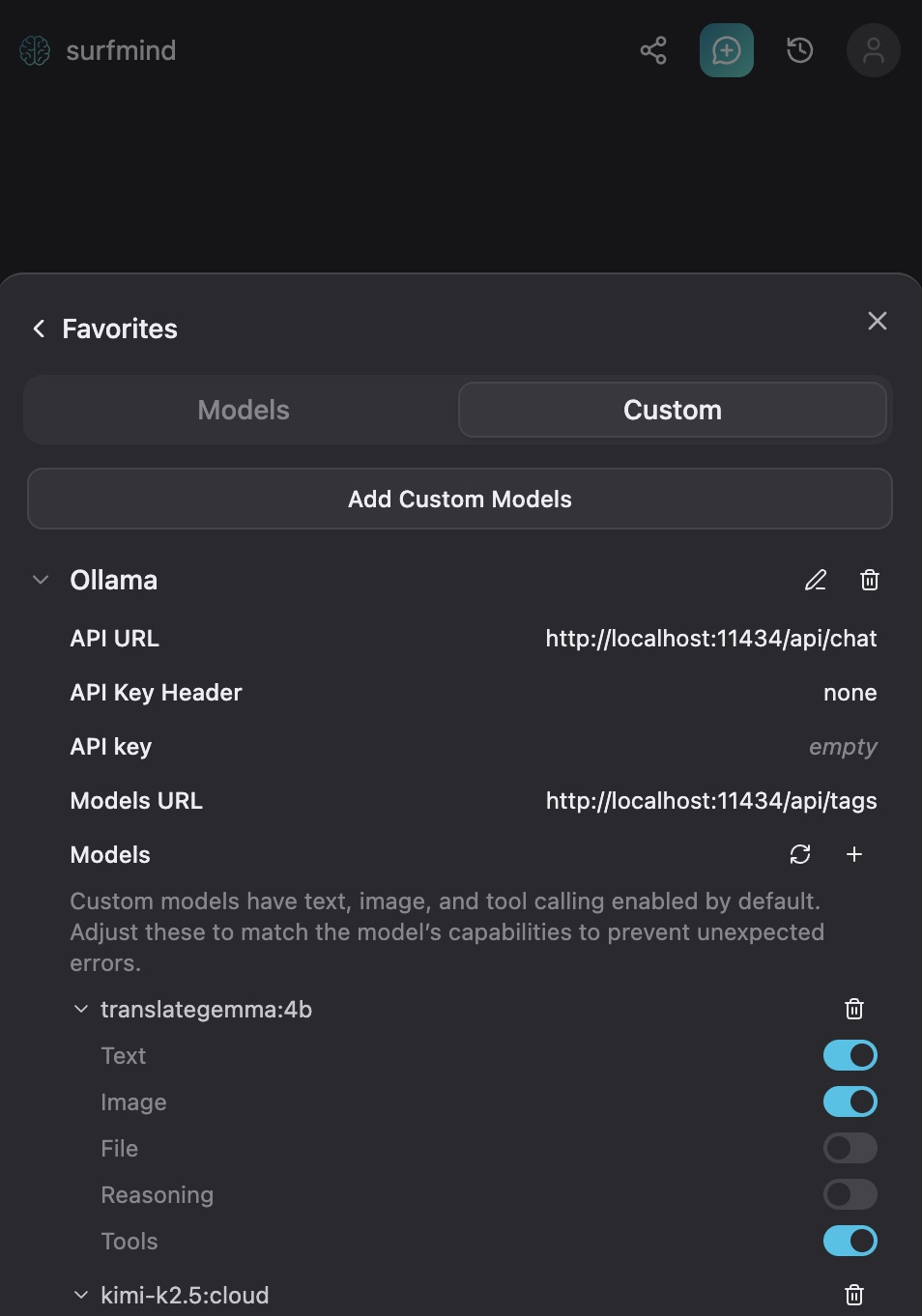

Bước 3. Nhấn tên mô hình ở dưới cùng panel SurfMind để mở Favorites, chuyển sang tab Custom.

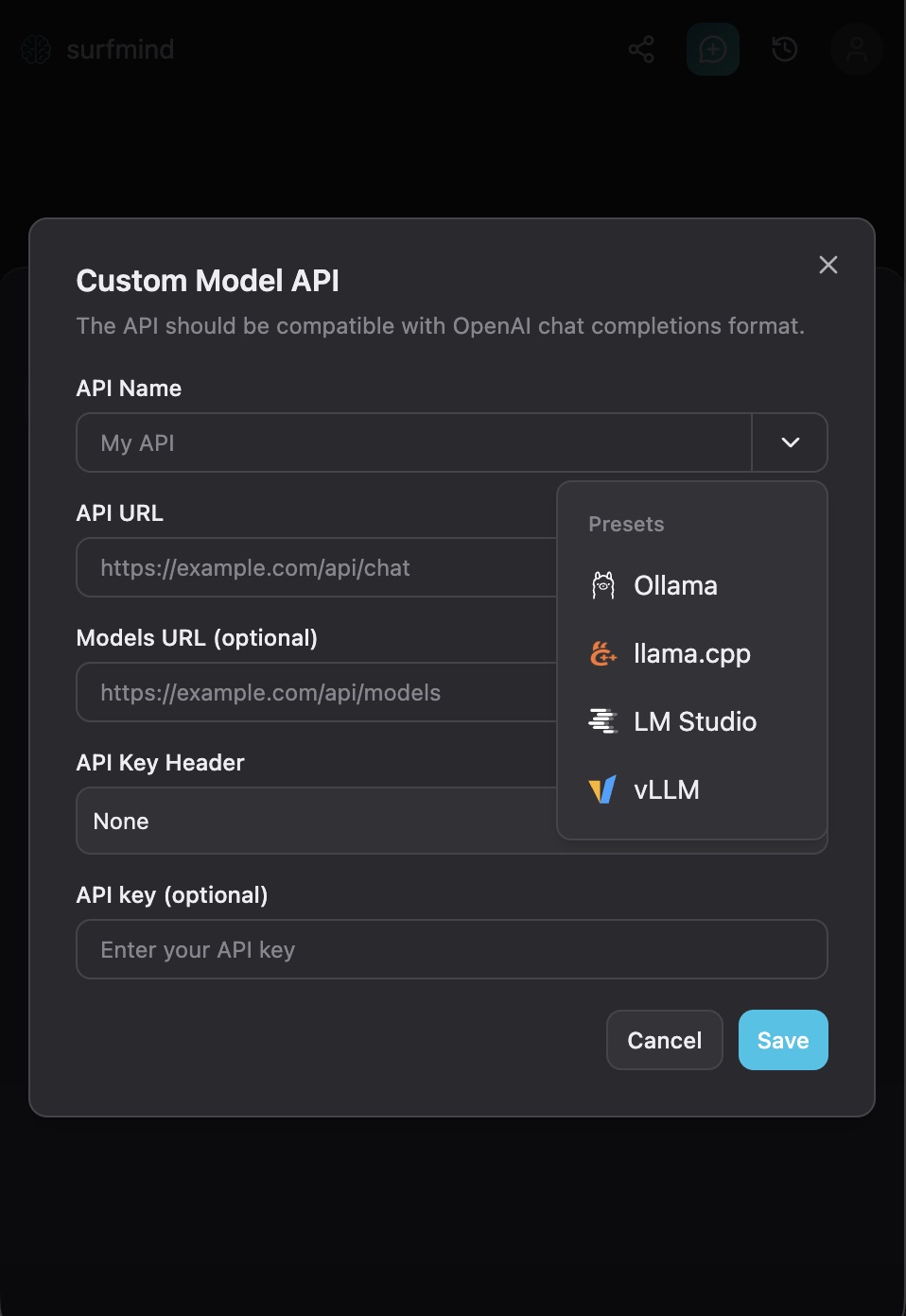

Bước 4. Nhấn Add Custom Models. Một form "Custom Model API" xuất hiện. Nhấn mũi tên dropdown ở ô tên API, bạn sẽ thấy menu Presets, chọn Ollama để tự động điền các trường:

- API URL:

http://localhost:11434/api/chat - Models URL:

http://localhost:11434/api/tags - API Key Header: Không có

- API Key: (để trống)

Bước 5. Nhấn Save. SurfMind kết nối với Ollama local, lấy danh sách mô hình bạn đã cài. Chúng sẽ hiện trong phần Ollama, sẵn để chọn.

Giờ truy cập trang web nào bạn muốn, mở SurfMind, chọn mô hình Ollama ở dưới cùng, bắt đầu hỏi về nội dung trên trang. Thế là xong.

Một số ví dụ thực tế nên thử

Dành cho nhà nghiên cứu và sinh viên: Mở bài báo học thuật, hỏi "lập luận chính là gì?" hoặc "tác giả thừa nhận những hạn chế nào?" Giúp bạn định hướng nhanh thay vì phải đọc lướt toàn bộ.

Dành cho lập trình viên: Mở tài liệu đang làm và hỏi rõ các vấn đề cụ thể. Rất hữu ích khi xử lý API hay framework mới mà không phải bật cửa sổ chat riêng biệt.

Dành cho kinh doanh: Trỏ vào báo cáo lợi nhuận, thông cáo báo chí, trang đối thủ, hoặc phân tích ngành. Hỏi những điểm đáng chú ý, những gì còn thiếu, hay những câu hỏi phát sinh. Với phân tích sâu, chuyển sang mô hình đám mây để có độ sâu hơn.

Dành cho người quan tâm riêng tư: Bất cứ khi nào bạn định dán nội dung lên ChatGPT mà ngần ngại vì lý do bảo mật, đây là sự thay thế an toàn.

Một vài lưu ý trung thực

Không công cụ AI nào hoàn hảo. Các mô hình có thể thỉnh thoảng đưa ra câu trả lời chắc chắn nhưng sai. Đây là hạn chế chung của mọi mô hình ngôn ngữ, không riêng gì cục bộ. Với các lĩnh vực cần độ chính xác cao như phân tích pháp lý, y tế, tài chính, hãy xem kết quả là điểm khởi đầu cần xác minh, không phải câu trả lời cuối cùng.

Tuy nhiên, chất lượng đã tiến bộ rất nhiều. Các mô hình nhỏ cục bộ đáp ứng hầu hết tác vụ hàng ngày tốt, và nếu bạn cần nhiều sức mạnh hơn, các mô hình đám mây của Ollama thu hẹp khoảng cách rất nhiều.

Đáng thử ít nhất một lần

Không gian AI cục bộ phát triển nhanh hơn hầu hết nghĩ. Một năm trước còn đòi hỏi kiến thức kỹ thuật đáng kể. Nay bạn chỉ cần hai lệnh terminal và một tiện ích trình duyệt để có trợ lý AI mạnh mẽ chạy trên mọi trang web, hoàn toàn riêng tư, miễn phí, và theo cách bạn muốn.

Nếu bạn từng tò mò về việc chạy AI riêng mà nghĩ quá phức tạp, Ollama chính là điều giúp bạn dễ tiếp cận. Cài đặt ngay chiều nay. Tải mô hình. Mở SurfMind trên bài viết bạn định đọc. Xem nó thay đổi trải nghiệm thế nào.

Và nếu dùng thử, hãy cho chúng tôi biết bạn dùng nó để làm gì. Các trường hợp sử dụng người dùng nghĩ ra luôn sáng tạo hơn những gì chúng tôi tưởng tượng.

Mô hình AI cục bộ của bạn đang chạy. Giờ hãy để nó làm việc trên mọi trang bạn duyệt.