كيفية استخدام Ollama للدردشة مع أي صفحة ويب

لقد لاحظت على الأرجح التغير الحاصل. ChatGPT موجود في كل مكان، لكن هناك أيضًا تزايد في القلق حوله. ماذا يحدث للوثائق التي تلصقها؟ من يقرأ مطالباتك؟ هل يمكن لصاحب العمل أو العملاء معرفة متى استخدمتها؟

هذه أسئلة عادلة. وهناك عدد متزايد من الناس توقفوا بهدوء عن طرحها لأنهم نقلوا إعدادات الذكاء الاصطناعي الخاصة بهم محليًا.

هذا هو موضوع هذا المنشور. سنستعرض Ollama، ما هو، كيف تقوم بإعداده، أي النماذج يستحق استخدامها، ثم ننتقل إلى الجزء المثير حقًا: استخدام الذكاء الاصطناعي مباشرة داخل متصفحك للتفاعل مع أي صفحة ويب تقرأها. لا اشتراكات. لا تغادر بياناتك جهازك إلا إذا أردت ذلك.

سواء كنت مطورًا، باحثًا، صحفيًا، أو فقط شخصًا فضوليًا تجاه الذكاء الاصطناعي ولا يحب فكرة تسجيل كل استعلام في مكان ما، فهذا المقال موجه إليك.

أولاً - ما هو Ollama؟

Ollama هي أداة مجانية ومفتوحة المصدر تتيح لك تنزيل وتشغيل نماذج لغوية كبيرة مباشرة على جهازك. ماك، ويندوز، لينكس، يعمل عليها جميعًا.

فكر فيها كمدير للنماذج. تختار نموذجًا، تنزله مرة واحدة، ويعمل كليًا على جهازك من تلك اللحظة. لا حاجة لاتصال بالإنترنت. لا تكاليف استخدام. لا سيرفر تابع لجهة خارجية يعالج استعلاماتك.

عندما أُطلق ChatGPT لأول مرة، كانت نماذج الذكاء الاصطناعي القوية متاحة فقط عبر الخدمات السحابية. الآن يمكنك تشغيل نماذج مماثلة محليًا وبخصوصية تامة، أو إذا كنت بحاجة إلى قوة أكبر، يمكنك استخدام سحابة Ollama دون تغيير الأدوات أو سير عملك. سنتحدث عن ذلك لاحقًا.

الفائدة العملية أكبر مما تبدو عليه. يمكنك تقديم مستندات حساسة، ملاحظات خاصة، صفحات ويب سرية، اعتمادًا على الوضع الذي تستخدمه، ولا حاجة لأن تنتقل هذه البيانات إلى أي مكان. وهذا يعني أيضًا أنك لا تدفع رسومًا لكل توكن تندمج تدريجيًا في تكلفة شهرية حقيقية.

ما هي استخدامات الناس لـ Ollama؟

قبل الشروع في الإعداد، من المفيد وضع الأمر في سياق حالات الاستخدام الحقيقية، لأن "تشغيل الذكاء الاصطناعي محليًا" قد يبدو مجرد مفهوم نظري.

يستخدم الناس النماذج المحلية لأغراض متنوعة مفاجئة: تلخيص تقارير طويلة، صياغة رسائل بريد إلكتروني، تصحيح الشيفرة، إجراء أبحاث دون رغبة في تخزين استعلاماتهم، تحليل العقود، معالجة ملاحظات الاجتماعات. يستخدم المطورون هذه الأدوات لاختبار سلوك النماذج في بيئة محكمة. يستخدم الكتاب ذلك للحصول على ملاحظات على المسودات دون القلق من استغلال أعمالهم كبيانات تدريب. يستخدم الطلاب هذه الأدوات لتناول المواضيع المعقدة دون استهلاك اشتراك.

القاسم المشترك هو السيطرة. يميل مستخدمو Ollama إلى الرغبة في العمل مع الذكاء الاصطناعي بشروطهم الخاصة، وليس من خلال بوابة اشتراك قد تغير الأسعار، تفرض قيودًا، أو تسجل جلساتهم.

إعداد Ollama

ما ستحتاجه

لا تحتاج إلى جهاز حديث جدًا، لكن الذاكرة العشوائية مهمة. نوصي بأن تكون 16 جيجابايت على الأقل لتجربة سلسة مع معظم النماذج. 8 جيجابايت ستعمل تقنيًا، لكنك ستقتصر على أصغر النماذج وقد تكون أوقات الاستجابة بطيئة. إذا كان لديك ماك مع Apple Silicon، فأنت في وضع جيد بشكل خاص، لأن بنية الذاكرة الموحدة تدير الذكاء الاصطناعي المحلي بكفاءة عالية. ويندوز ولينكس يعملان جيدًا أيضًا.

التثبيت

يدعم Ollama المنصات الرئيسية (macOS، لينكس، ويندوز). أسهل طريقة للتثبيت:

# On macOS or Linux

curl -fsSL https://ollama.com/install.sh | sh

# Or use Homebrew on macOS

brew install ollama

# On Windows, download the installer from Ollama’s website https://ollama.com/download/windowsبمجرد التثبيت، يشغل Ollama خادمًا محليًا في الخلفية على المنفذ 11434. يمكنك التحقق من عمله بفتح المتصفح وزيارة http://localhost:11434 حيث سترى رسالة تأكيد.

تنزيل النموذج الأول

افتح الطرفية ونفذ:

ollama pull llama3.2هذا يحمل نموذج Llama 3.2 من Meta إلى جهازك (~2 جيجابايت). أمر run يتولى أيضًا التنزيل تلقائيًا إذا تخطيت إلى:

ollama run llama3.2اكتب سؤالك. احصل على إجابة. أنت الآن تشغّل نموذج لغة قوي تمامًا على جهازك وحده.

أي نموذج ينبغي أن تستخدم؟

مكتبة Ollama تحتوي على أكثر من 100 نموذج، مما قد يبدو مربكًا في البداية. إليك نقطة انطلاق عملية:

| النموذج | مناسب لـ | الذاكرة العشوائية المطلوبة |

|---|---|---|

gemma3:2b |

الأجهزة القديمة أو محدودة المواصفات | ~4 جيجابايت |

llama3.2 |

الاستخدام اليومي العام | ~8 جيجابايت |

mistral |

السرعة ومهام الترميز | ~8 جيجابايت |

deepseek-r1 |

التحليل، المنطق، البحث | ~8 جيجابايت |

llama3.3:70b |

أقصى قدرة محلية | ~32 جيجابايت أو أكثر |

إذا كنت تبدأ لتوك، فإن llama3.2 هو الخيار المناسب. سريع، متوازن، ويعمل بشكل مريح على معظم الحواسيب المحمولة الحديثة.

يمكنك التحقق من قائمة النماذج المثبتة بواسطة هذا الأمر:

ollama listشيء يستحق المعرفة: هذه النماذج لها تاريخ انتهاء معرفة ولا تملك وصولًا للمعلومات الحية. للمحتوى اللحظي، مثل صفحة ويب تقرأها حاليًا، ستحتاج إلى تزويد النموذج بالسياق مباشرة. وهذا ما نعمل عليه بالضبط.

ماذا لو احتجت نموذجًا أكبر وأكثر قوة؟

النماذج المحلية رائعة، لكنها محدودة بعتاد جهازك. نموذج ببارامترات 70 مليار يحتاج لذاكرة ضخمة. نموذج بـ 671 مليار بارامتر ببساطة لن يعمل على جهاز شخصي.

هنا تأتي نماذج سحابة Ollama. التي أُطلقت أواخر 2025، تتيح لك تشغيل نماذج ضخمة على أجهزة بمواصفات مراكز بيانات باستخدام نفس واجهة Ollama التي تعرفها. نفس الأوامر، نفس API، نفس الأدوات.

ollama run deepseek-v3.1:671b-cloudنماذج السحابة المتوفرة تشمل:

deepseek-v3.1:671b-cloud: أحد أقوى النماذج ذات الوزن المفتوح المتاحةqwen3-coder:480b-cloud: مخصص لمهام الترميزgpt-oss:120b-cloudوgpt-oss:20b-cloud: نماذج أوبن إيه آي ذات الوزن المفتوح

نماذج السحابة تتصرف تمامًا كنماذج المحلية. الفرق الوحيد هو أنها تتطلب تسجيل الدخول إلى ollama.com أولًا:

ollama signinوالمهم: سحابة Ollama لا تحتفظ ببياناتك. فتحصل على قوة النماذج السحابية الكبيرة دون التضحية بالخصوصية المعتادة.

الفائدة العملية: استخدم النماذج المحلية للعمل الحساس حيث لا ينبغي أن تغادر بياناتك جهازك. وانتقل إلى النماذج السحابية عند الحاجة لأقصى طاقة. Ollama تدير كلا الأمرين بسلاسة، ما عليك سوى اختيار وسم النموذج الذي ينتهي بـ -cloud.

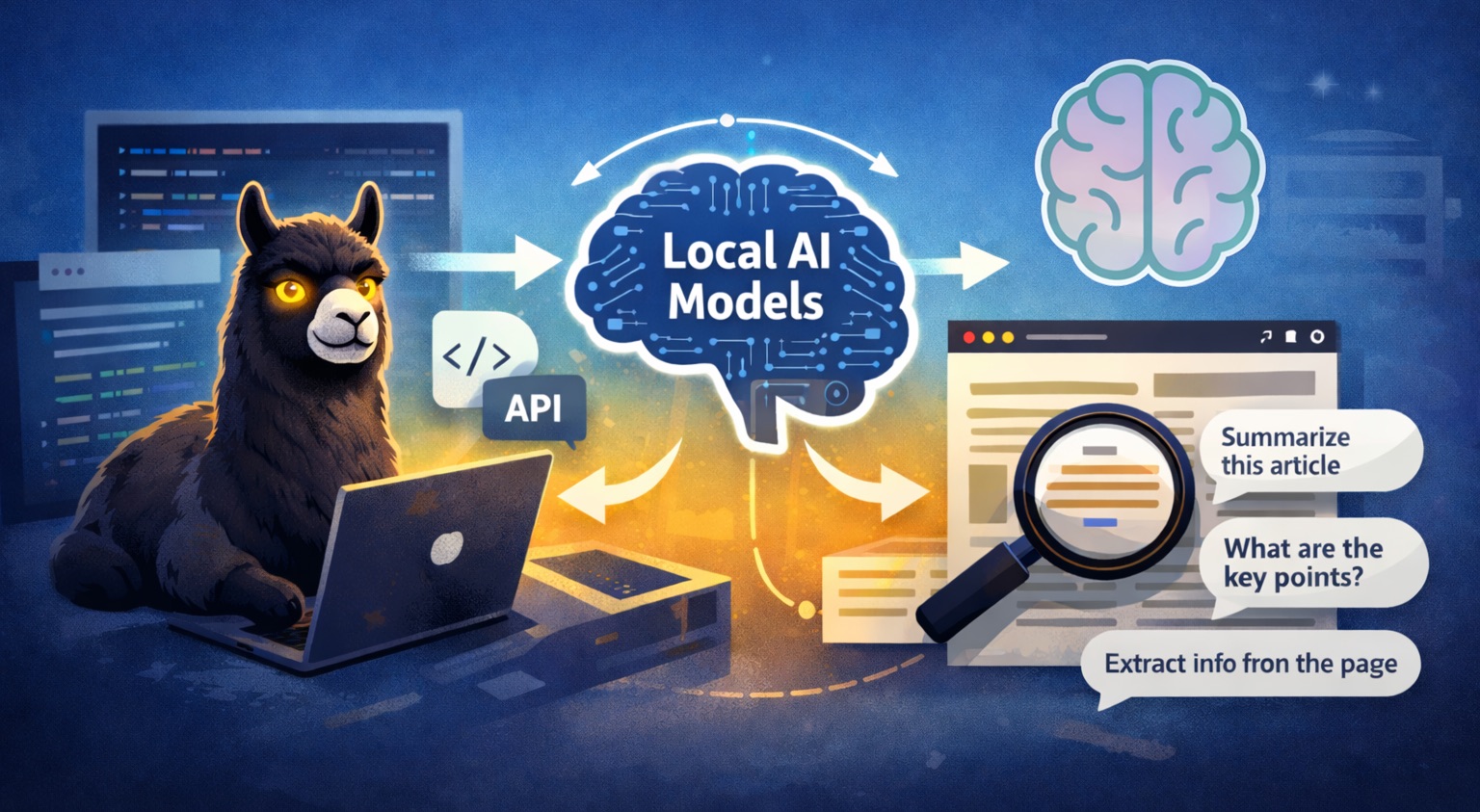

الجزء الذي يغير فعليًا طريقة عملك: المحادثة مع صفحات الويب

هنا يصبح الأمر مثيرًا.

Ollama وحده مفيد. لكن ربطه بمتصفحك، بحيث يمكنك توجيهه إلى أي صفحة ويب وطرح أسئلة عن المحتوى المعروض، هو حيث يتحول سير العمل من "تجربة رائعة" إلى شيء ستستخدمه يوميًا بالفعل.

فكر فيما يفتح هذا:

- تقرأ ورقة بحثية معقدة؟ اطلب من النموذج تلخيص المنهجية، شرح النتائج بلغة بسيطة، أو الإشارة إلى أي شيء يبدو مبالغًا فيه.

- تراجع صفحة أسعار منافس؟ اسأل عن الفروقات، أو ما الذي يغيب بشكل ملحوظ.

- تمر بمقال إخباري طويل؟ احصل على الادعاءات الرئيسية، تحقق من تطابق العنوان مع المحتوى، استمع إلى الرد المعاكس.

- تنظر إلى إعلان وظيفة؟ اسأل ما إذا كانت خبراتك تطابق ما يصفونه فعلاً.

- تعمل على مستند قانوني أو شروط الخدمة؟ احصل على شرح بلغة بسيطة دون لصق نص حساس في أداة سحابية.

كل ذلك حسب شروطك الخاصة. محتوى الصفحة يُرسل إلى النموذج الذي اخترته.

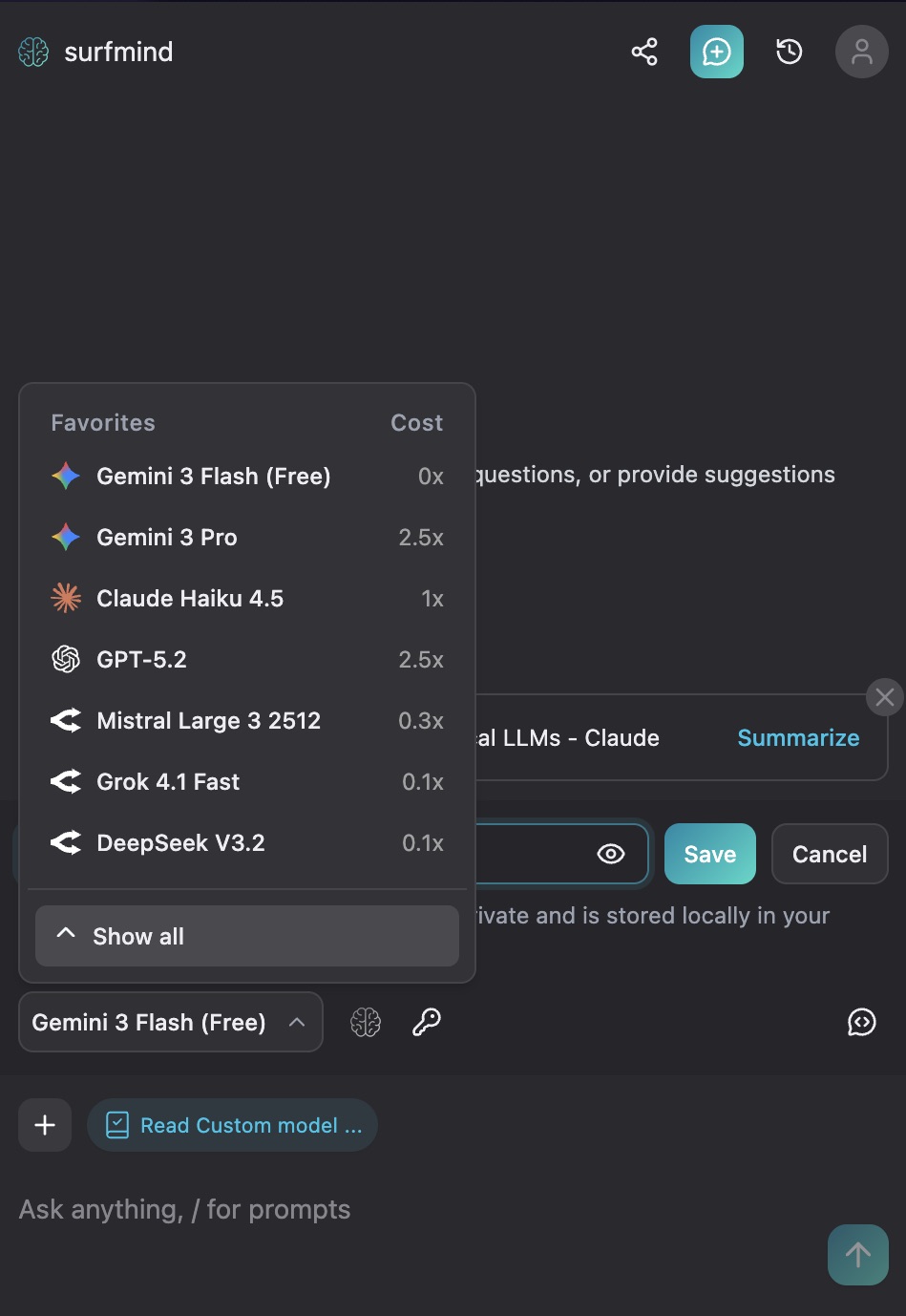

كيف تفعل ذلك مع SurfMind

SurfMind هو امتداد متصفح مبني لهذا الغرض بالذات. يقرأ محتوى الصفحة التي تتصفحها ويسمح لك بإجراء محادثة حقيقية حولها مباشرة في المتصفح، دون نسخ وصق.

يدعم نماذج Ollama المحلية مباشرة، وكذلك نماذج سحابة Ollama، ويمنحك مساعدًا ذكياً قويًا يعمل على الويب بالكامل حسب شروطك.

إليك طريقة ربطهما:

الخطوة 1. قبل تشغيل Ollama، فعّل إمكانية الوصول للمتصفح عن طريق هذا الأمر مرة واحدة:

# Mac/Linux

OLLAMA_ORIGINS="*" ollama serve

# Windows (PowerShell)

$env:OLLAMA_ORIGINS="*"; ollama serveهل تحصل على خطأ "المنفذ 11434 مستخدم بالفعل"؟ هذا يعني أن تطبيق Ollama يعمل في الخلفية. قم بإغلاقه أولًا على ماك، ابحث عن أيقونة Ollama في شريط القوائم واختر Quit؛ على ويندوز، ابحث عنه في علبة النظام. ثم نفذ الأمر أعلاه مرة أخرى.

الخطوة 2. قم بتثبيت SurfMind من متجر Chrome وافتحه على أي صفحة.

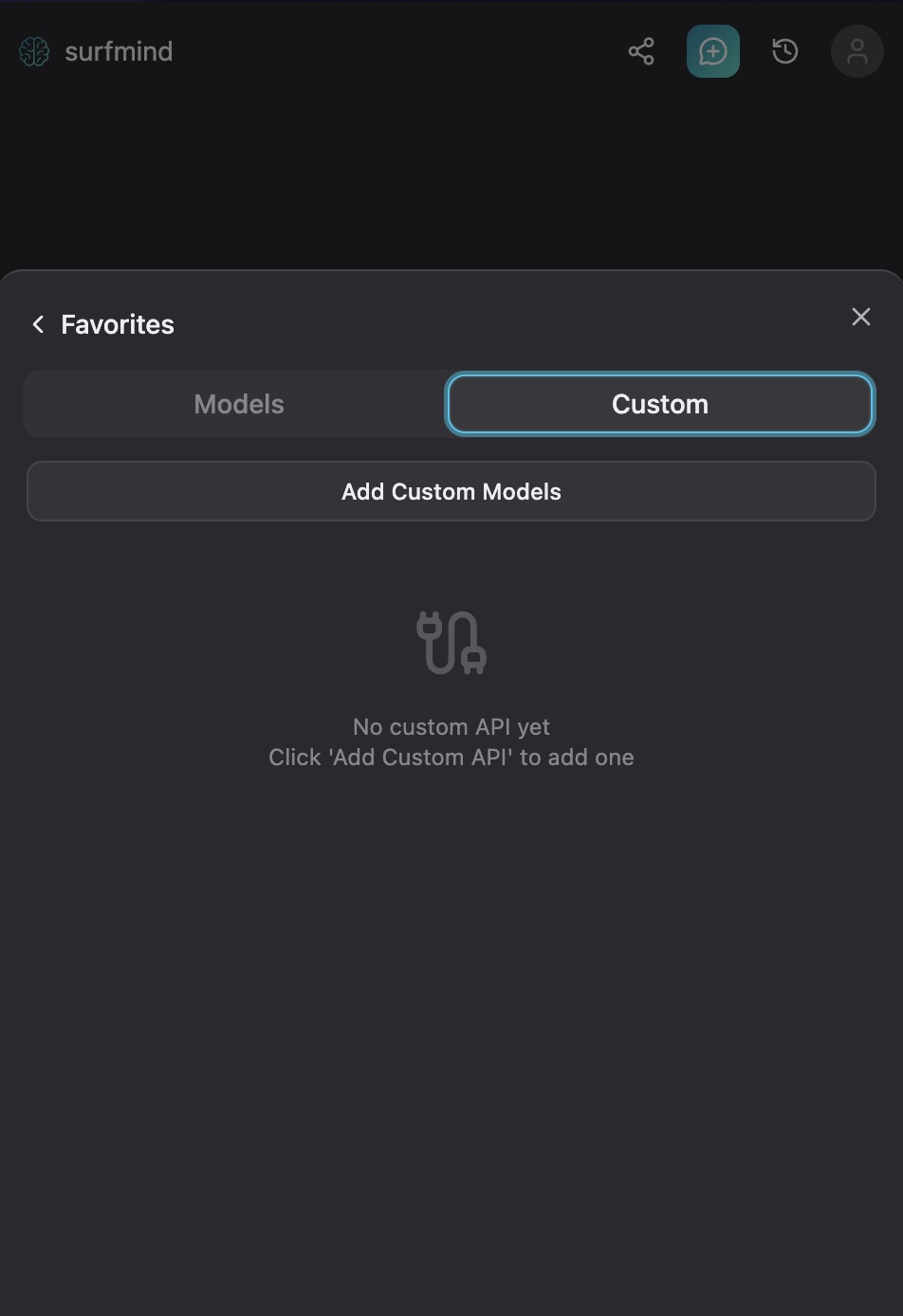

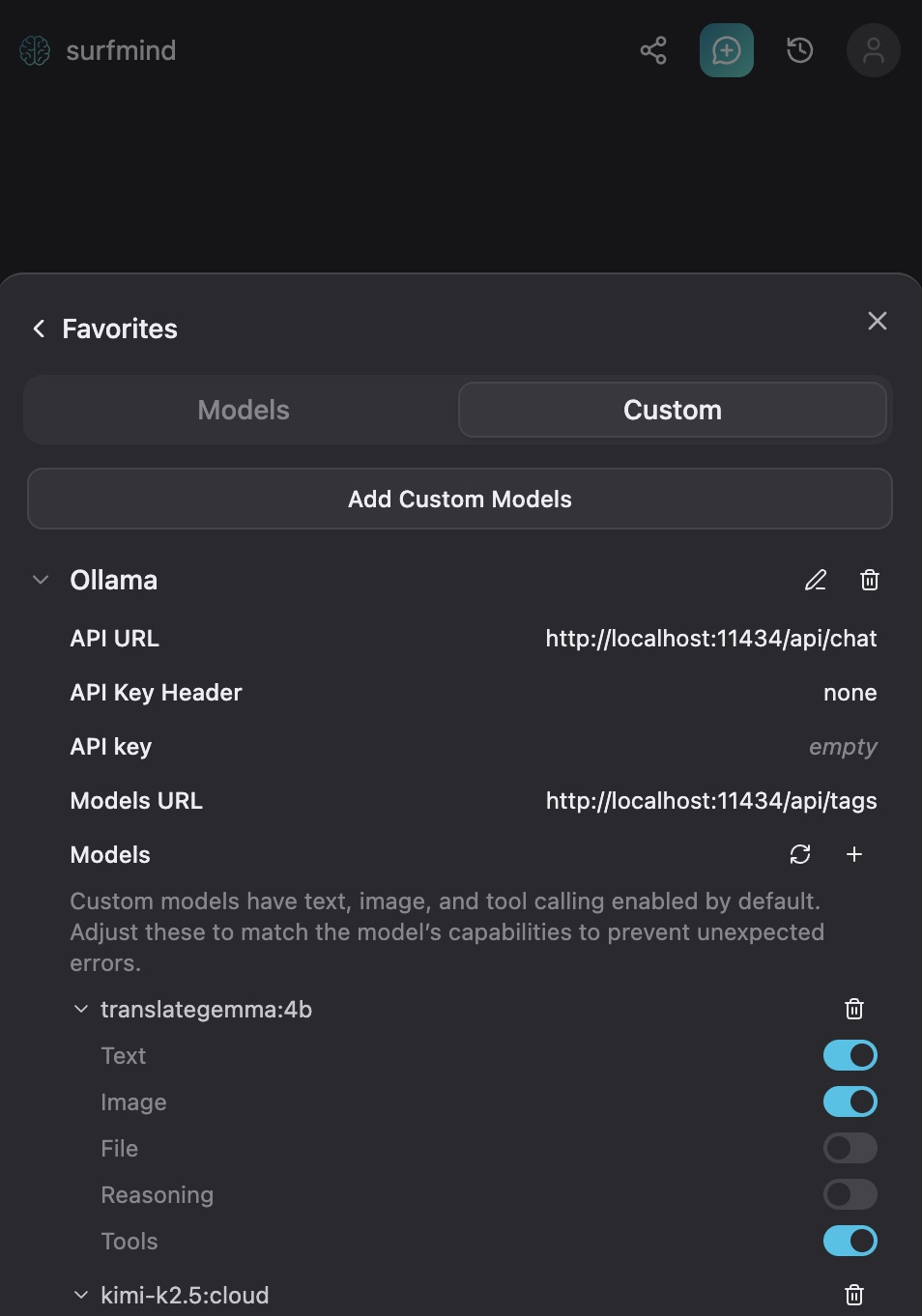

الخطوة 3. انقر على اسم النموذج في أسفل لوحة SurfMind لفتح المفضلات، ثم انتقل إلى تبويب مخصص.

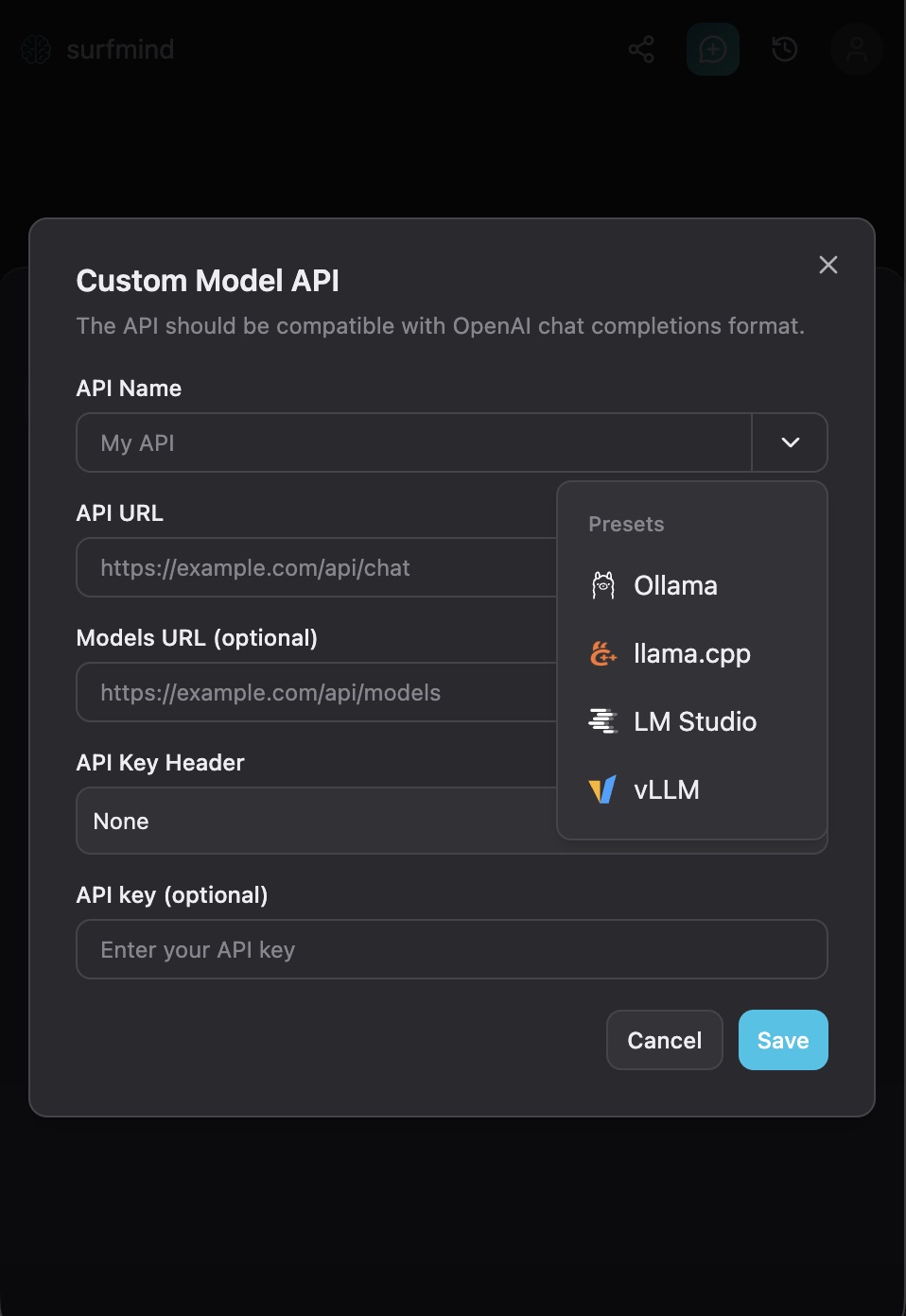

الخطوة 4. انقر على إضافة نماذج مخصصة. ستظهر لك نموذج " API نموذج مخصص". انقر على السهم بجانب حقل اسم API، سترى قائمة الإعدادات المسبقة مع Ollama مدرجًا مسبقًا. اختر Ollama وسيتم ملء الحقول كلها تلقائيًا:

- رابط API:

http://localhost:11434/api/chat - رابط النماذج:

http://localhost:11434/api/tags - رأس مفتاح API: لا شيء

- مفتاح API: (اتركه فارغًا)

الخطوة 5. اضغط حفظ. سيتصل SurfMind بنسخة Ollama المحلية الخاصة بك ويسحب قائمة النماذج المثبتة. ستظهر تحت قسم Ollama، وجاهزة للاختيار.

الآن تصفح أي صفحة ويب، افتح SurfMind، اختر نموذج Ollama من القائمة في الأسفل، وابدأ بطرح الأسئلة عن محتوى الصفحة. هذا كل شيء.

أمثلة عملية جديرة بالتجربة

للباحثين والطلاب: افتح أي مقال أكاديمي واطرح "ما الحجة الرئيسية هنا؟" أو "ما القيود التي اعترف بها المؤلفون؟" ستتمكن من استيعاب المضمون في ثوان بدلًا من تصفح القطعة بأكملها لإيجاد القسم المعني.

للمطورين: افتح توثيقًا تعمل عليه واطرح أسئلة محددة عنه. مفيد جدًا للتنقل بين APIs أو أُطُر عمل غير مألوفة دون الانقطاع لفتح نافذة محادثة منفصلة.

للاستخدام التجاري: وجهه نحو تقارير الأرباح، البيانات الصحفية، صفحات المنافسين، أو تحليلات الصناعة. اسأل عن الملاحظات المهمة، ما الذي يغيب، أو ما الأسئلة التي يثيرها. للتحليلات العميقة، استخدم نموذجًا سحابيًا لمزيد من التفاصيل.

للمهتمين بالخصوصية في الاستخدام اليومي: كلما كنت عادة تلصق شيئًا في ChatGPT لكن ترددت بسبب محتواه، هذه هي البديل.

بعض التنبيهات الصادقة

لا توجد أداة ذكاء اصطناعي معصومة عن الخطأ. ستنتج النماذج أحيانًا إجابات واثقة لكنها خاطئة. هذه محدودية جميع نماذج اللغة، ليست مشكلة محلية فقط. لأي شيء يحتاج إلى دقة مثل التحليل القانوني، الأسئلة الطبية، القرارات المالية، اعتبر المخرجات نقطة انطلاق يجب التحقق منها، لا إجابة نهائية.

مع ذلك، تحسنت الجودة كثيرًا. النماذج المحلية الأصغر تتعامل جيدًا مع معظم المهام اليومية، وإذا احتجت إلى مزيد من القوة النارية، تقرب نماذج سحابة Ollama الفجوة بدرجة كبيرة.

يستحق التجربة، حتى مرة واحدة فقط

مساحة الذكاء الاصطناعي المحلي ناضجة أسرع مما يظن الكثيرون. قبل عام، كان هذا يتطلب جهدًا تقنيًا ملموسًا. اليوم، أنت على بعد أمرين في الطرفية وامتداد متصفح واحد من الحصول على مساعد ذكاء اصطناعي قوي يعمل على أي صفحة ويب خاصتك، مجانًا، وبخصوصية تامة.

إذا كنت فضوليًا بشأن تشغيل إعداد الذكاء الاصطناعي الخاص بك لكن افترضت أنه معقد جدًا، فإن Ollama هو ما يجعل الأمر بسيطًا ومريحًا. ثبته هذا المساء. نزّل نموذجًا. افتح SurfMind على المقال التالي الذي ستقرأه على أية حال. شاهد كيف يغير التجربة.

وإذا جربته، أخبرنا كيف تستخدمه. حالات الاستخدام التي يكتشفها الناس تكون عادة أكثر إبداعًا مما نتوقع.

نموذج الذكاء الاصطناعي المحلي الخاص بك يعمل الآن. اجعله يعمل على كل صفحة تتصفحها.